クリアフィルター

記事

Mihoko Iijima · 2022年2月28日

開発者のみなさん、こんにちは。

今回は、スーパーやコンビニでもらうレシートを写真で撮り、OCR を使ってレシートの画像から文字列を切り出して IRIS に登録する流れを試してみました。

サンプルでは、Google の Vision API を利用してレシートの JPG 画像から購入物品をテキストで抽出しています。

サンプルコード一式 👉 https://github.com/Intersystems-jp/iris-embeddedpython-OCR

最初、オンラインラーニングで使っている 「tesseract-OCR」を使ってみようと思ったのですが、レシートには半角カナが混在していたりで、半カナがなかなかうまく切り出せず、あきらめました・・(半角カナがなかったら日本語もばっちり読めていたのですが・・)

もし、tesseract-OCR で半カナを切り出す良い方法をご存知の方いらっしゃいましたら、ぜひ教えてください!

今回試すにあたり、Vision API の使い方を詳しく書いているページがありましたのでコードなど参考させていただきました。ありがとうございました。

【Google Colab】Vision APIで『レシートOCR』

全体の流れですが、レシートの写真を JPG にし、Python の google-cloud-vision モジュールを使用して JPG を Vision API に渡し、テキストを切り出します。

切り出されたテキストを画像の位置に合わせて一旦ソートし、レシートに記載されているものが店名なのか、商品名なのか、金額なのか、など、IRIS に登録したい項目を Python の正規表現モジュール re を使用してチェックし IRIS に登録しています。

IRIS にデータを登録する部分はSQLでもできますが、今回のサンプルでは1対多のリレーションシップを使った永続クラスを利用しています。

(永続クラスに対してSQLでも操作ができるので、お好みの文法で操作できます)

1側クラス:Okaimono.Receipt

レシートの基本情報を格納します。(店名、買い物時間、購入合計、割引金額など)

多側クラス:Okaimono.Item

レシートに記載された詳細項目の項目名と金額を格納します。

サンプルの実行方法については、こちらをご参照ください。

以下、コードについて少しご紹介します。

Python 側のコード:receipt.py は、ほぼこちらの素晴らしい記事👉【Google Colab】Vision APIで『レシートOCR』 を参考にさせていただきましたので、詳しくは記事をご参照ください。

Vision API で切り出したテキストですが、IRISへ登録するために必要な情報を正規表現で取り出して Python の list に設定し、receiptIRIS.py に渡して IRIS に保存しています。

レシートの項目ですが、お店によって表記が様々だったため(半カナ混在だったり全角だけだったり、記号が付いたりつかなかったり、など)、ご紹介するサンプルでは「オーケー」のレシートに合った正規表現を利用しています。コンビニや他スーパーの場合、サンプルの正規表現に合わないと思いますので、receipt.py の 72 行目~ 80 行目辺りをご変更いただくことで、お好みのレシートを読めるようになります。ぜひお試しください。

今回、IRIS に登録するデータは、1対多のリレーションシップクラスを利用しているので、データの登録には SQL ではなくオブジェクトの文法を利用しています(もちろんSQLでも登録できます)。

具体的にどんなコードを書いているかというと、前回の記事「Embedded Python 試してみました」と同様に、Python から IRIS 内のクラスを操作するための iris モジュールのインポートと、クラスの操作に使用する iris.cls() を利用しています。

Okaimono.Receipt のインスタンス生成は以下の通りです。

import iris

receipt=iris.cls("Okaimono.Receipt")._New()

receipt.StoreName="○×商店"

そして、作成された Python の list を読みながら、レシートの詳細項目を登録します。

コードはこんな感じです。

Okaimono.Item のインスタンスを生成し、Name プロパティとPrice プロパティに値を登録し、

item=iris.cls("Okaimono.Item")._New()

item.Name="チョコ"

item.Price="100"

Okaimono.Item のインスタンス と Okaimono.Receipt のインスタンスを関連付けます。(Okaimono.Item クラスの Receiptリレーションシッププロパティを利用して Okaimono.Receipt クラスのインスタンスを代入しています)

item.Receipt=receipt

この方法の他に、1側の Okaimono.Receipt の Items プロパティ(リレーションシッププロパティ)に提供される Insert() メソッドを使用して Okaimono.Item のインスタンスを Okaimono.Receipt のインスタンスに割り当てる方法もあります。(どちらか一方の割り当て方法で大丈夫です)

receipt.Items.Insert(item)

上記操作をレシートに記載された購入品目分実行し、最後にレシートを IRIS に保存します。

st=receipt._Save()

これで、Okaimono.Receipt に紐づく Okaimono.Item が一括で保存されます。

以下の文例は、2つの商品を購入したときのレシート登録例です。

USER>do ##class(%SYS.Python).Shell()

Python 3.9.5 (default, Jan 25 2022, 13:57:42) [MSC v.1927 64 bit (AMD64)] on win32

Type quit() or Ctrl-D to exit this shell.

>>> import iris

>>> receipt=iris.cls("Okaimono.Receipt")._New()

>>> receipt.StoreName="テストストア"

>>> receipt.TotalPrice=778

>>> it1=iris.cls("Okaimono.Item")._New()

>>> it1.Name="お弁当"

>>> it1.Price=598

>>> receipt.Items.Insert(it1)

1

>>> it2=iris.cls("Okaimono.Item")._New()

>>> it2.Name="ジュース"

>>> it2.Price=180

>>> it2.Receipt=receipt

>>> receipt._Save()

1

>>>

登録されたデータを確認します。

IRIS では、1対多のリレーションシップ定義を行った場合、多側クラス(Okaimono.Item)のリレーションシップ用プロパティ:Receipt が外部キーカラムのようにテーブルに投影されます。

以下、確認例です。

まずは、Okaimono.Receipt データを確認します。

SELECT * FROM Okaimono.Receipt

上記実行例では、「テストストア」のデータは ID=2 で登録されています。

続いて、Okaimono.Item データを確認します。

SELECT * FROM Okaimono.Item

Receipt 列には、リレーションシッププロパティで定義した1側クラス(Okaimono.Receipt)の ID が登録されていることがわかります。

では、次に、Receipt が 2(Okaimono.Receipt の ID=2)の Okaimono.Item 全情報と Okaimono.Receipt の StoreName と TotalPrice を取得してみます。

SELECT *,Receipt->StoreName,Receipt->TotalPrice FROM Okaimono.Item Where Receipt=2

IRIS 独自の矢印構文(->)を利用しています。この構文はオブジェクトの定義によって作成された外部キー用カラムを利用して、参照先テーブルのカラムを指定できる文法で、Receipt->StoreName は、Okaimono.Item テーブルに紐づく Okaimono.Receipt テーブルの StoreName カラムを指定しています。

これは、1対多のリレーションシップやオブジェクト参照を利用している場合に利用できる方法で、内部的には左外部結合と一緒の処理を行っています。

IRIS 独自の書き方ではありますが、意外とすっきりと記述できるので見やすさ重視の場合に利用いただくケースもあります。

矢印構文について詳細はドキュメントもご参照ください。

ちなみに、Pythonシェル上で 1件の Okaimono.Receipt をオープンし、Okaimono.Receipt に紐づく Okaimono.Item を取得する場合のオブジェクトの文法は以下の通りです。

ID=2 の Okaimono.Receipt をオープンします。

>>> r1=iris.cls("Okaimono.Receipt")._OpenId(2)

何個の Okaimono.Item と紐づいているか確認するには、Okaimono.Receipt クラスのリレーションシッププロパティ=Items に対して Count() を使用します。

>>> r1.Items.Count()

2

1件目の Okaimono.Item を取得する例は以下の通りです。

>>> it1=r1.Items.GetAt(1)

>>> it1.Name

'お弁当'

>>> it1.Price

598

2件目も確認してみます。

>>> it2=r1.Items.GetAt(2)

>>> it2.Name

'ジュース'

>>> it2.Price

180

こんな感じで、SQLからもオブジェクトからも操作できることが確認できました。

Embedded Python の登場で、Python の便利なモジュールや公開されているサンプルコードが IRIS から実行しやすくなりました。

みなさんのお手元でもぜひお試しください!

そして、お試しいただいた内容など、お気軽にコミュニティに投稿してみてください!お待ちしてます🔥

記事

Mihoko Iijima · 2022年4月14日

これは、InterSystems FAQサイトの記事です。

アプリケーションモニタが提供する %Monitor.System.Diskspace(ディスク容量メトリック)を利用して指定サイズを下回る場合にメール通知を行うように設定を追加することができます。

アプリケーション・モニタのメトリック【IRIS】アプリケーション・モニタのメトリック

システム提供のアプリケーションモニタは、デフォルトでは全て無効化されています。使用を開始するためには、対象のモニタを有効化し、システムモニタを再起動します。

アプリケーションモニタの有効/無効やシステムモニタの停止/開始は、システムルーチン ^%SYSMONMGR を利用します。

以下の例では、ディスクの空き容量が 100MB を下回る場合にメール通知を行う設定手順について説明します。

手順は以下の通りです。

1) ^%SYSMONMGR を起動し、アプリケーションモニタから %Monitor.System.Diskspace を有効化する

2) アラート対象とする閾値を変更する(例では、通知は最初の1回のみとしています)

3) Email通知設定を行う

4) システムモニタを再起動する

1) ^%SYSMONMGR を起動し、アプリケーションモニタから %Monitor.System.Diskspace を有効化する

ドキュメントは以下ご参照ください。Manage Monitor Classes【IRIS】Manage Monitor Classes

%SYS>do ^%SYSMONMGR

1) Start/Stop System Monitor

2) Set System Monitor Options

3) Configure System Monitor Classes

4) View System Monitor State

5) Manage Application Monitor

6) Manage Health Monitor

7) View System Data

8) Exit

Option? 5 → 5 を入力してEnter押下

1) Set Sample Interval

2) Manage Monitor Classes

3) Change Default Notification Method

4) Manage Email Options

5) Manage Alerts

6) Exit

Option? 2 → 2 を入力してEnter押下

1) Activate/Deactivate Monitor Class

2) List Monitor Classes

3) Register Monitor System Classes

4) Remove/Purge Monitor Class

5) Set Class Sample Interval

6) Debug Monitor Classes

7) Exit

Option? 1 → 1 を入力してEnter押下

Class? ? → ? を入力してEnter押下

Num MetricsClassName Activated

1) %Monitor.System.HistoryMemory N

2) %Monitor.System.HistoryPerf N

3) %Monitor.System.HistorySys N

4) %Monitor.System.HistoryUser N

5) %Monitor.System.AuditCount N

6) %Monitor.System.AuditEvents N

7) %Monitor.System.Clients N

8) %Monitor.System.Diskspace N

9) %Monitor.System.Freespace N

10) %Monitor.System.Globals N

11) %Monitor.System.Journals N

12) %Monitor.System.License N

13) %Monitor.System.LockTable N

14) %Monitor.System.Processes N

15) %Monitor.System.Routines N

16) %Monitor.System.Servers N

17) %Monitor.System.SystemMetrics N

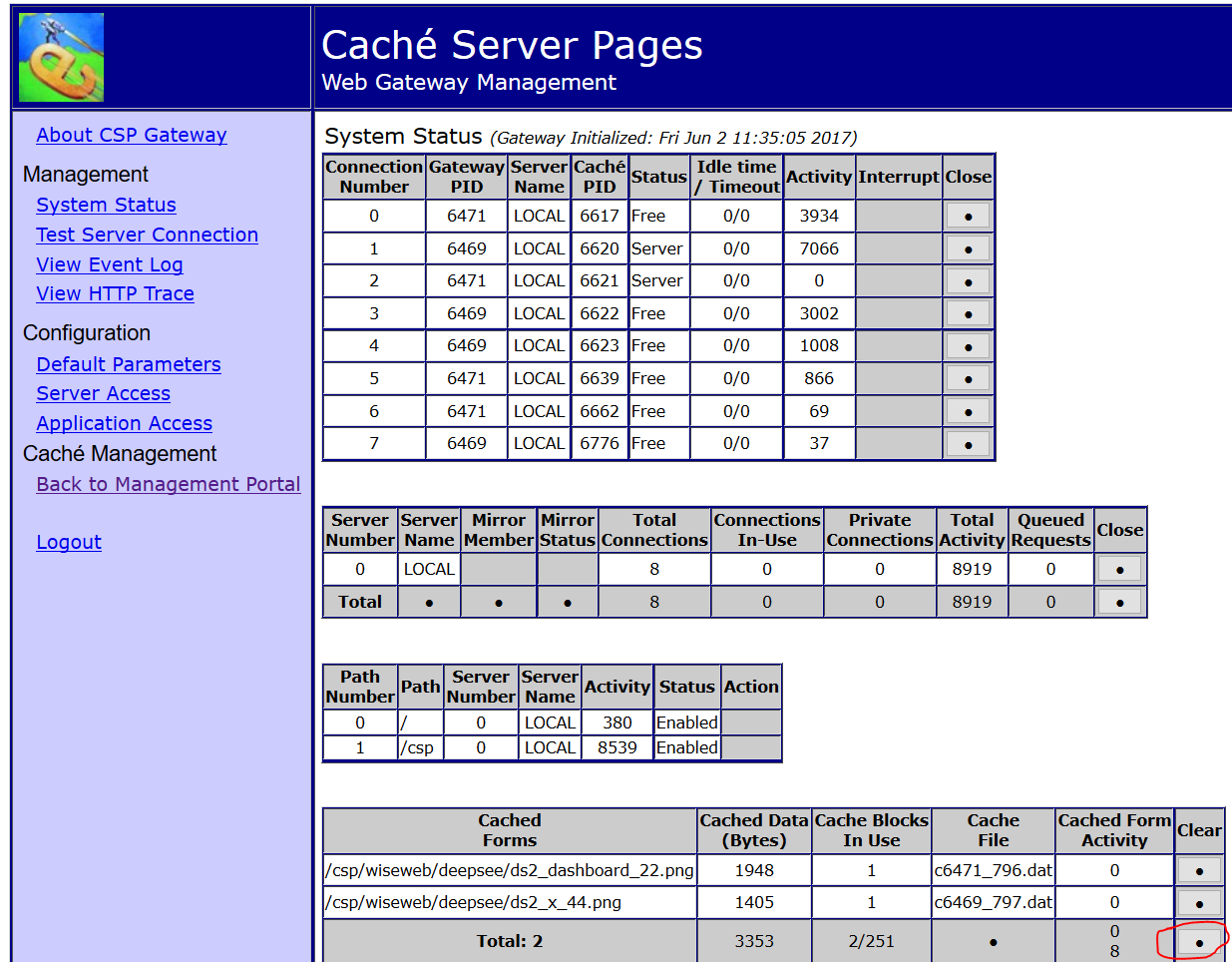

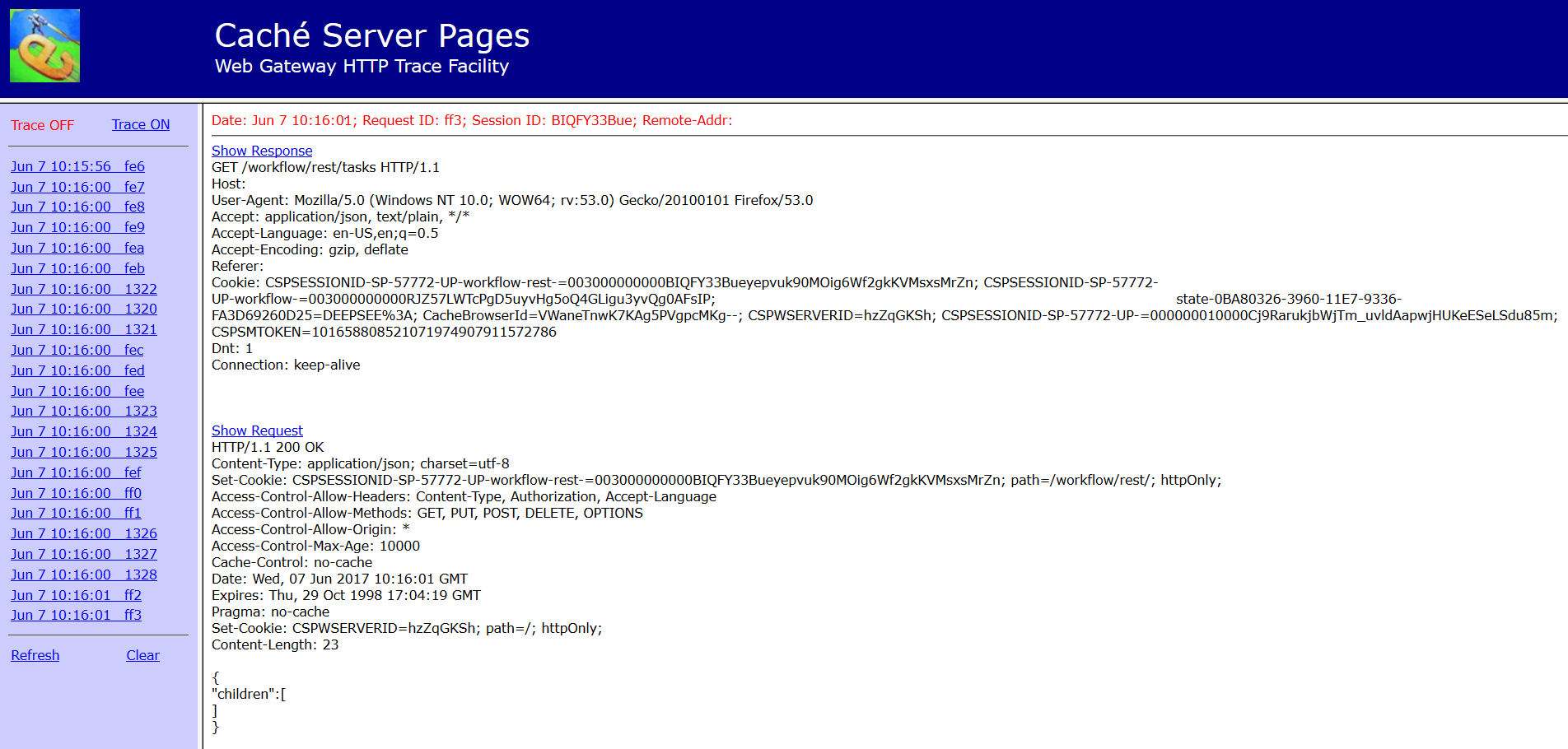

18) %Monitor.System.CSPGateway N

Class? 8 %Monitor.System.Diskspace →上のリストの 8 を指定してEnter押下

Activate class? Yes => yes → yes を入力してEnter押下

1) Activate/Deactivate Monitor Class

2) List Monitor Classes

3) Register Monitor System Classes

4) Remove/Purge Monitor Class

5) Set Class Sample Interval

6) Debug Monitor Classes

7) Exit

Option? →Enter押下(前のメニューに戻ります)

1) Set Sample Interval

2) Manage Monitor Classes

3) Change Default Notification Method

4) Manage Email Options

5) Manage Alerts

6) Exit

Option?

2) アラート対象とする閾値を変更する(例では、通知は最初の1回のみとしています)

※以下実行例は、1) の続きで記述しています。^%SYSMONMGRの実行から始めている場合は、5) Manage Application Monitor 選択後の画面から開始してください。

ドキュメントは以下ご参照ください。Manage Alerts【IRIS】Manage Alerts

1) Set Sample Interval

2) Manage Monitor Classes

3) Change Default Notification Method

4) Manage Email Options

5) Manage Alerts

6) Exit

Option? 5 → 5 を入力してEnter押下

1) Create Alert

2) Edit Alert

3) List Alerts

4) Delete Alert

5) Enable/Disable Alert

6) Clear NotifyOnce Alert

7) Exit

Option? 1 → 1 を入力してEnter押下

Alert name? test disk free space alert → 任意のアラート名を入力してEnter押下

Application? %SYS (Enter '-' to reset) => → Enter押下

Action (0=default,1=email,2=method)? 0 => 1 → 1 を入力してEnter押下

Raise this alert during sampling? Yes => yes → yes を入力してEnter押下

Class? ? → ? を入力してEnter押下

Num MetricsClassName Activated

1) %Monitor.System.HistoryMemory N

2) %Monitor.System.HistoryPerf N

3) %Monitor.System.HistorySys N

4) %Monitor.System.HistoryUser N

5) %Monitor.System.AuditCount N

6) %Monitor.System.AuditEvents N

7) %Monitor.System.Clients N

8) %Monitor.System.Diskspace Y

9) %Monitor.System.Freespace N

10) %Monitor.System.Globals N

11) %Monitor.System.Journals N

12) %Monitor.System.License N

13) %Monitor.System.LockTable N

14) %Monitor.System.Processes N

15) %Monitor.System.Routines N

16) %Monitor.System.Servers N

17) %Monitor.System.SystemMetrics N

18) %Monitor.System.CSPGateway N

Class? 8 %Monitor.System.Diskspace → 上のリストの 8 を指定してEnter押下

Property? ? → ? を入力してEnter押下

Num Name Activated

1) Database Y

2) Directory Y

3) Diskspace Y

4) Diskstatus Y

Property? 3 Diskspace → 上のリストの 3 を指定してEnter押下

Property? Properties list: Diskspace

Evaluation expression (e.g., "%1=99")? %1<100 ←MB単位に指定します。例では「100MB未満の場合アラート」を指定してEnter押下

Expression expands to: If Diskspace<100. OK? Yes => Yes → Yes を入力してEnter押下

Notify once only? No => yes → yes を入力してEnter押下

1) Create Alert

2) Edit Alert

3) List Alerts

4) Delete Alert

5) Enable/Disable Alert

6) Clear NotifyOnce Alert

7) Exit

Option? →Enter押下(前のメニューに戻ります)

1) Set Sample Interval

2) Manage Monitor Classes

3) Change Default Notification Method

4) Manage Email Options

5) Manage Alerts

6) Exit

Option? →Enter押下(前のメニューに戻ります)

3) Email通知設定を行う

以下の例では、gmail を利用する例をご紹介しています。gmail は SSL構成を事前に作成する必要があります。管理ポータルの以下メニューから事前に作成してください。

管理ポータル > システム管理 > セキュリティ管理 > SSL/TLS構成

※ 構成名以外はデフォルト値を利用します。

※以下実行例は、2)の続きで記述しています。^%SYSMONMGR の実行から始めている場合は、5) Manage Application Monitor 選択後の画面から開始してください。

ドキュメントは以下ご参照ください。Manage Email Options【IRIS】Manage Email Options

1) Start/Stop System Monitor

2) Set System Monitor Options

3) Configure System Monitor Classes

4) View System Monitor State

5) Manage Application Monitor

6) Manage Health Monitor

7) View System Data

8) Exit

Option? 5 → 5 を入力してEnter押下

1) Set Sample Interval

2) Manage Monitor Classes

3) Change Default Notification Method

4) Manage Email Options

5) Manage Alerts

6) Exit

Option? 4 → 4 を入力してEnter押下

1) Enable/Disable Email

2) Set Sender

3) Set Server

4) Manage Recipients

5) Set Authorization

6) Test Email

7) Exit

Option? 3 → 3 を入力してEnter押下

Mail server? smtp.gmail.com → メールサーバを入力してEnter押下

Mail server port? 587 → メールサーバのポート番号を入力してEnter押下

Mail server SSLConfiguration? gmail → 管理ポータルで設定したSSL構成名を入力してEnter押下

Mail server UseSTARTTLS? 0 => 1 → 1を入力してEnter押下

1) Enable/Disable Email

2) Set Sender

3) Set Server

4) Manage Recipients

5) Set Authorization

6) Test Email

7) Exit

Option? 2 → 2 を入力してEnter押下

Sender? sendertest@gmail.com → 差出人のメールアドレスを入力してEnter押下

1) Enable/Disable Email

2) Set Sender

3) Set Server

4) Manage Recipients

5) Set Authorization

6) Test Email

7) Exit

Option? 5 → 5 を入力してEnter押下

User name? xxxabctestaccount@gmail.com → 認証用アカウント名を入力してEnter押下

Password? → パスワードを入力してEnter押下

1) Enable/Disable Email

2) Set Sender

3) Set Server

4) Manage Recipients

5) Set Authorization

6) Test Email

7) Exit

Option? 4 → 4 を入力してEnter押下

1) List Recipients

2) Add Recipient

3) Remove Recipient

4) Exit

Option? 2 → 2 を入力してEnter押下

Email Address? abc@testcorp.com → 送信先メールアドレスを入力してEnter押下

1) List Recipients

2) Add Recipient

3) Remove Recipient

4) Exit

Option? →Enter押下(前のメニューに戻ります)

1) Enable/Disable Email

2) Set Sender

3) Set Server

4) Manage Recipients

5) Set Authorization

6) Test Email

7) Exit

Option? 1 → 1 を入力してEnter押下

Email is currently OFF

Change Email setting? No => yes → yes を入力してEnter押下

1) Enable/Disable Email

2) Set Sender

3) Set Server

4) Manage Recipients

5) Set Authorization

6) Test Email

7) Exit

Option? 6 → 6 を入力してEnter押下

Sending email on Mail Server smtp.gmail.com

From: sendertest@gmail.com

To: abc@testcorp.com

1) Enable/Disable Email

2) Set Sender

3) Set Server

4) Manage Recipients

5) Set Authorization

6) Test Email

7) Exit

Option? →Enter押下(前のメニューに戻ります)

1) Set Sample Interval

2) Manage Monitor Classes

3) Change Default Notification Method

4) Manage Email Options

5) Manage Alerts

6) Exit

Option? →Enter押下(前のメニューに戻ります)

1) Start/Stop System Monitor

2) Set System Monitor Options

3) Configure System Monitor Classes

4) View System Monitor State

5) Manage Application Monitor

6) Manage Health Monitor

7) View System Data

8) Exit

Option? →Enter押下(前のメニューに戻ります)

4) システムモニタを再起動する

設定を反映させるため、システムモニタを一度停止し、開始します。

ドキュメントは以下ご参照ください。Start/Stop System Monitor【IRIS】Start/Stop System Monitor

%SYS>do ^%SYSMONMGR

1) Start/Stop System Monitor

2) Set System Monitor Options

3) Configure System Monitor Classes

4) View System Monitor State

5) Manage Application Monitor

6) Manage Health Monitor

7) View System Data

8) Exit

Option? 1 → 1 を入力してEnter押下

1) Start System Monitor

2) Stop System Monitor

3) Exit

Option? 2 → 2 を入力してEnter押下

Stopping System Monitor... System Monitor stopped

1) Start System Monitor

2) Stop System Monitor

3) Exit

Option? 1 → 1 を入力してEnter押下

Starting System Monitor... System Monitor started

1) Start System Monitor

2) Stop System Monitor

3) Exit

Option? →Enter押下(前のメニューに戻ります)

1) Start/Stop System Monitor

2) Set System Monitor Options

3) Configure System Monitor Classes

4) View System Monitor State

5) Manage Application Monitor

6) Manage Health Monitor

7) View System Data

8) Exit

Option? →Enter押下(ネームスペースのプロンプトに戻ります)

%SYS>

この記事に関連する記事もあります。以下ご参照ください。

SYS.Database クラスの FreeSpace クエリを使用してデータベースのあるディスクの空き容量を確認する方法

記事

Toshihiko Minamoto · 2022年10月25日

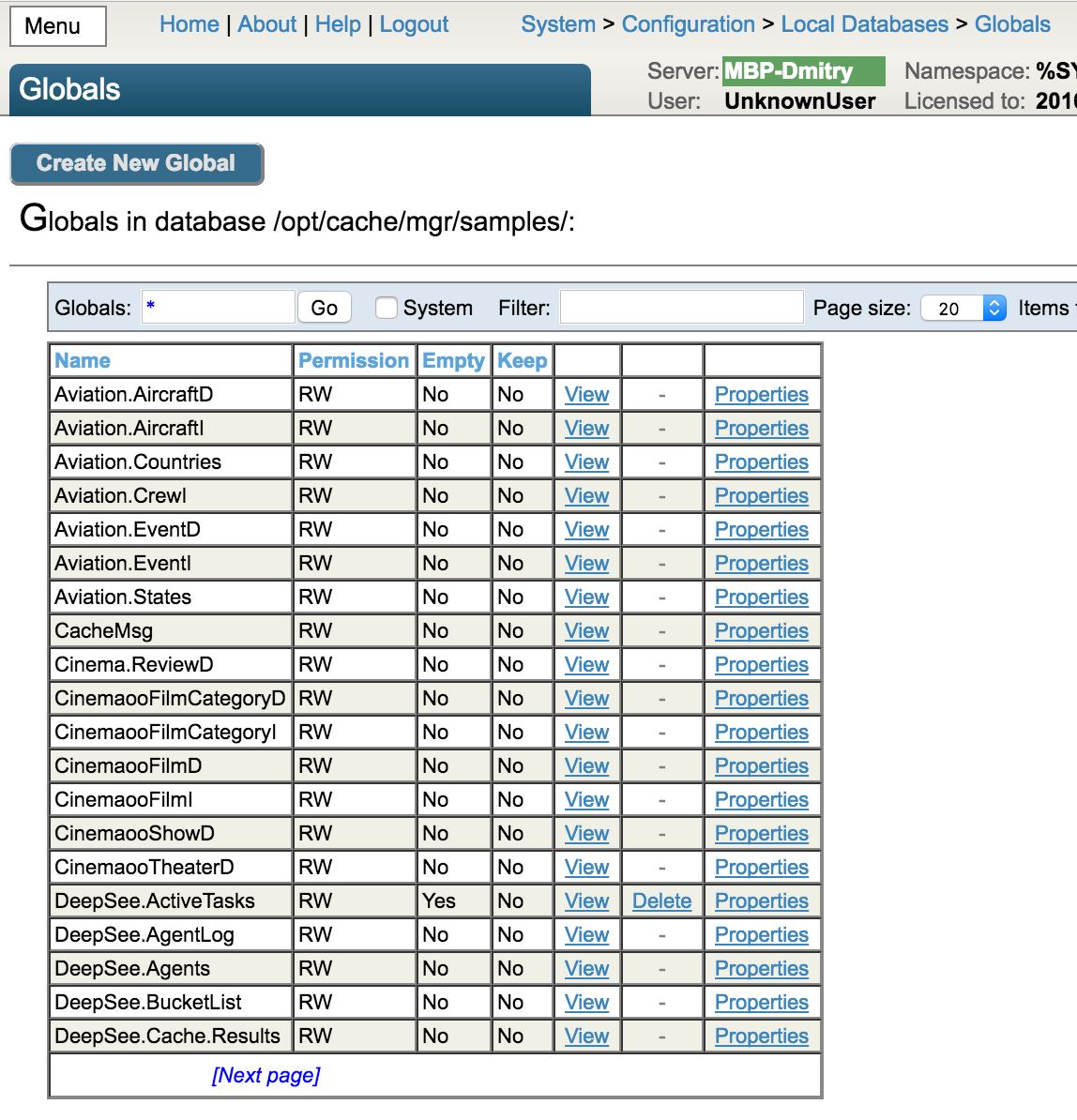

私が一番興味を持っているのは、組み込み Python におけるグローバルの使用についてです。そこで、提供されている公式ドキュメントを確認しました。

#1 グローバルの導入グローバルとは何かについての一般的な説明。 次の章につながっています。

#2 ObjectScript の詳細について組み込み Python の記述はありません。さらに先に進むと...

#3 組み込み Python

3.1 組み込み Python の概要3.1.1 グローバルの使用グローバルを使ったことなければ、素晴らしい内容です。が、驚くほど原始的な例が使われています。3.2 組み込み Python の使用最後の望み: >>> でも、目に見えるものが何もありません。残念どころではありません! Python 用の IRIS Native API でさえ、もっと説明されています。何を期待していたかと言うと...

グローバルノードの SET、GET、KILL

Native API: 基本的なノード操作 そして

$DATA()、$ORDER()、$QUERY() によるナビゲーション

Native API: nextSubscript() と isDefined() によるイテレーションそこで、自分で調査し、リバースエンジニアリングを行って、実験しなければなりませんでした。

そしてわかったこと:

すべての例は IRIS for Windows (x86-64) 2022.1 (Build 209U) にある Python Shell で説明されており、暗黙的な print() 関数を集中的に使用している。

グローバル

何をするにも、iris.gref クラスを使って、グローバルの参照オブジェクトを作成することから始める必要があります。グローバル名は、直接文字列として、またはCOS/ISOS の間接式のように変数として渡されます。グローバルを扱っていることが明確であるため、最初のキャレット (^) は不要です!

>>> globalname='rcc'

>>> nglob=iris.gref(globalname)

>>> glob=iris.gref('rcc')

>>> cglob=iris.gref('^rcc')

上記は、同じグローバルへの 3 つのグローバル参照です。単なる参照であり、このグローバルが存在するかことを示すものではありません。

対話式ドキュメント: print(glob.__doc__)InterSystems IRIS グローバル参照オブジェクト。グローバルへの参照を取得するには、iris.gref() メソッドを使用します。

サブスクリプト

すべてのグローバルサブスクリプトは、Py リストの [sub1,sub2] として渡されます。 COS/ISOS とあまり変わりません。トップレベルに特別な処理が必要なだけです。サブスクリプトなしを示すには、空のリストではなく、この [None] を使用します。

SET

グローバルを設定するには、COS/ISOS と同様に「直接」行うことができます。

>>> glob[1,1]=11

または、gref.set() メソッドを使用することもできます。

>>> glob.set([1,3],13)

対話式ドキュメント: print(glob.set.__doc__)グローバルのキーが指定されている場合、グローバルのそのキーに格納された値を設定します。 例: g.set([i,j], 10) は、グローバル g のキー i,j にあるノードの値を 10 に設定します。

グローバルノードのコンテンツにアクセスするには、COS/ISOS と同様に「直接」行うことができます。

>>> glob[1,3]

13

または、gref.get() メソッドを使用することもできます。

>>> glob.get([1,1])

11

対話式ドキュメント: print(glob.get.__doc__)グローバルのキーが指定されている場合、グローバルのそのノードに格納された値を返します。例: x = g.get([i,j]) は x を、グローバル g のキー i,j に格納された値に設定します。

注意: これは COS/ISOS の $GET() ではありません。

>>> glob.get([1,99])

Traceback (most recent call last):

File "", line 1, in <module>

KeyError: 'Global Undefined'

>>>

ただし、直接使用すると、COS/ISOS の $GET() のように動作します。

>>> x=glob[1,99]

>>> print(x)

None

>>>

この None は、SQL が表現するところの NULL を指します。 後で、もう一度出現します。

KILL

期待される結果を達成する gref.kill() メソッドのみがあります。

>>> glob.kill([1,3])

>>> y=glob[1,3]

>>> print(y)

None

>>>

対話式ドキュメント: print(glob.kill.__doc__)グローバルのキーが指定されている場合、グローバルのそのノードとサブツリーをキルします。例: g.kill([i,j]) は、グローバル g のキー i,j に格納されたノードとその子孫ノードをキルします。

$DATA()

関連するメソッドは gref.data() です。対話式ドキュメント: print(glob.data.__doc__)グローバルのキーが指定されている場合、その状態を返します。例: x = g.data([i,j]) は x を 0、1、10、11 に設定します。 0-if が未定義、1-定義済み、10-未定義で子孫あり、11-値と子孫あり期待どおりに動作します。

>>> glob.data()

10

>>> glob.data([None])

10

>>> glob[None]=9

>>> glob.data([None])

11

>>> glob.data([1,1])

1

>>> glob.data([1,3])

0

>>>

$ORDER()

この例では、グローバル ^rcc にノードをいくつか追加しました。

>zw ^rcc

^rcc=9

^rcc(1,1)=11

^rcc(1,2)=12

^rcc(2,3,4)=234

^rcc(2,3,5)=235

^rcc(2,4,4)=244

^rcc(7)=7

関連するメソッドは gref.order() です。対話式ドキュメント: print(glob.order.__doc__)グローバルのキーが指定されている場合、そのグローバルの次のキーを返します。例: j = g.order([i,j]) は j を、グローバル g の次の第 2 レベルのキーに設定します。つまり、以下のようになります。

>>> print(glob.order([]))

1

>>> print(glob.order([1]))

2

>>> print(glob.order([2]))

7

>>> print(glob.order([7]))

None

>>> print(glob.order([1,'']))

1

>>> print(glob.order([1,1]))

2

>>> print(glob.order([2,3,]))

4

>>> print(glob.order([2,3,""]))

4

>>> print(glob.order([2,3,4]))

5

>>> print(glob.order([2,4,4]))

None

>>>

ここでは、参照として欠落しているサブスクリプトまたは空の文字列は同等です。

$QUERY()

関連するメソッドは gref.query() です。対話式ドキュメント: print(glob.query.__doc__)指定されたキーからグローバルをトラバースし、各キーと値をタプルとして返します。例: for (key, value) in g.query([i,j]) は、キー i,j から g をトラバースし、各キーと値を返します。

このメソッドの動作は COS/ISOS と異なります。

開始ノード以降のすべてのノードを返します。

格納されたコンテンツを含めます。

None と示されているコンテンツのない仮想ノードも返します。 ここでの小さな例は、次のようになります(読みやすいように囲んでいます)。

>>> print(list(glob.query()))

[(['1'], None), (['1', '1'], 11), (['1', '2'], 12), (['2'], None),

(['2', '3'], None), (['2', '3', '4'], 234), (['2', '3', '5'], 235),

(['2', '4'], None), (['2', '4', '4'], 244), (['7'], 7)]

>>>

もっと読みやすくすると、次のようになります。

>>> for (key, value) in glob.query():

... print(key,''.ljust(20-len(str(list(key))),'>'),value)

...

['1'] >>>>>>>>>>>>>>> None

['1', '1'] >>>>>>>>>> 11

['1', '2'] >>>>>>>>>> 12

['2'] >>>>>>>>>>>>>>> None

['2', '3'] >>>>>>>>>> None

['2', '3', '4'] >>>>> 234

['2', '3', '5'] >>>>> 235

['2', '4'] >>>>>>>>>> None

['2', '4', '4'] >>>>> 244

['7'] >>>>>>>>>>>>>>> 7

>>>

絶対に ZWRITE ではありません!

もう 1 つのオプションは、gref.keys() のみを使用してサブスクリプトを取得する方法です。対話式ドキュメント: print(glob.keys.__doc__)指定されたキーからグローバルをトラバースし、そのグローバルの各キーを返します。例: for key in g.keys([i, j]) は、キー i,j から g をトラバースし、各キーを返します。 >>>

>>> list(glob.keys())

[['1'], ['1', '1'], ['1', '2'], ['2'], ['2', '3'], ['2', '3', '4'],

['2', '3', '5'], ['2', '4'], ['2', '4', '4'], ['7']]

>>>

そして、これで gref.orderiter() を見つけました。対話式ドキュメント: print(glob.orderiter.__doc__)指定されたキーからグローバルをトラバースし、次のキーと値をタプルとして返します。例: for (key, value) in g.orderiter([i,j]) は、キー i,j から g をトラバースし、次のキーと値を返します。

$QUERY() のようにコンテンツをフェッチして、そのコンテンツを次のサブノードに提供することも行う $ORDER() のように動作します。以下を見てください。

>>> list(glob.orderiter([]))

[(['1'], None), (['1', '1'], 11)]

>>> list(glob.orderiter([1]))

[(['2'], None), (['2', '3'], None), (['2', '3', '4'], 234)]

>>> list(glob.orderiter([2]))

[(['7'], 7)]

>>>

最後に、gref.getAsBytes() メソッドがあります。対話式ドキュメント: print(glob.getAsBytes.__doc__)グローバルのキーが指定されている場合、そのグローバルのそのノードに格納されている文字列をバイトで返します。例: x = g.getAsBytes([i,j]) は x をグローバル g のキー i,j に格納されている値をバイトとして設定します。

数値には失敗しますが、 文字列には有効です。

>>> glob[5]="robert"

>>> glob.get([5])

'robert'

>>> glob.getAsBytes([5])

b'robert'

また、COS/ISOS で set ^rcc(9)=$lB(99,"robert") を実行すると以下のようになります。

>>> glob[9]

'\x03\x04c\x08\x01robert'

>>> glob.getAsBytes([9])

b'\x03\x04c\x08\x01robert'

>>>

これらのメソッドを以下のようにして検出しました。

>>> for meth in glob.__dir__():

... meth

...

'__len__'

'__getitem__'

'__setitem__'

'__delitem__'

'__new__'

'data'

'get'

'set'

'kill'

'getAsBytes'

'order'

'query'

'orderiter'

'keys'

'__doc__'

'__repr__'

'__hash__'

'__str__'

'__getattribute__'

'__setattr__'

'__delattr__'

'__lt__'

'__le__'

'__eq__'

'__ne__'

'__gt__'

'__ge__'

'__init__'

'__reduce_ex__'

'__reduce__'

'__subclasshook__'

'__init_subclass__'

'__format__'

'__sizeof__'

'__dir__'

'__class__'

>>>

これで、組み込み Python からグローバルに直接アクセスする必要がある場合に、作業が楽になることを願っています。個人的に学んだこと: ほとんどの場合に、ドキュメントがあります。 . . . どこにあるかは別ですが。ただ、探し回る必要があるだけです。

動画デモ

Traduction française

記事

Tomohiro Iwamoto · 2020年12月10日

この記事は、GitHub Actions を使って GKE に InterSystems IRIS Solution をデプロイするの継続記事で、そこではGitHub Actions パイプラインを使って、 Terraform で作成された Google Kubernetes クラスタにzpm-registry をデプロイしています。 繰り返しにならないよう、次の項目を満たしたものを開始点とします。

訳者注) 上記の記事を読まれてから、本記事に進まれることをお勧めしますが、GKE上のサービスにドメイン名を紐づける方法を解説した単独記事としてもお読みいただけます。

リポジトリ Github Actions + GKE + zpm example をフォーク済みで、フォークでの Actions を許可していること。 この記事を通して、ルートディレクトリは <root_repo_dir>として参照されます。

Terraform ファイルのプレースホルダを置換済みであること。

GitHub Actions を使って GKE に InterSystems IRIS Solution をデプロイする の唯一の表に記載されているすべてのシークレットを(GitHub Actions Secrets ページで)作成済みであること。

コピーペースト作業を単純化するために、すべてのコードサンプルが、GitHub-GKE-TLS リポジトリに保存されるようになっていること。

上記のすべてを満たしていることを前提に、先に進みましょう。

はじめに

前回、zpm-registry への接続は、次のように行いました。

curl -XGET -u _system:SYS 104.199.6.32:52773/registry/packages/-/all

IP アドレスの前にプロトコルがない場合は HTTP を使用していることを示します。つまり、トラフィックは非暗号化であるため、かの悪名高いイブ によってパスワードを盗み聞きされる可能性があります。

イブが盗聴できないようにするには、トラフィックを暗号化する、つまり HTTPS を使用する必要があります。 それは可能なことなのでしょうか。

104.199.6.32:52773/registry/packages → https://104.199.6.32:52773/registry/packages

概して言えば、可能です。 IP アドレスの証明書を取得すればよいのですが、 このソリューションには欠点があります。 詳細については、Using an IP Address in an SSL Certificate と SSL for IP Address を読んでいただきたいのですが、 要約すると、静的 IP アドレスが必要であり、その機能を備えた証明書プロバイダーは無料ではありません。 メリットについても、疑わしい部分があります。

一般的な無料プロバイダーは、9 Best Free SSL Certificate Sources にも紹介されているように、幸いにも存在はします。 その 1 つは Let’s Encrypt ですが、証明書を発行するのはドメイン名に対してのみです。ちなみに、証明書に IP アドレスを追加する計画は上がってはいます。

したがって、トラフィックを暗号化するには、まず、ドメイン名を取得する必要があります。 ドメイン名をすでにお持ちの方は、次のセクションにスキップしてください。

ドメイン名の取得

ドメインレジストラからドメイン名を購入します。 かなりの数のレジストラが存在し、 価格はドメイン名やサービスレベルによって異なります。 開発の目的には、たとえば .dev のドメインを使うことができますし、おそらく安価でもあります。

ここでは、ドメイン登録プロセスには触れませんが、それほど複雑なものではありません。これ以降では、登録済みのドメイン名を example.com として説明することにします。 これを自分のドメインに置き換えてください。

ドメイン登録プロセスが完了すると、ドメイン名とドメインゾーンを得られますが、 これらは別々のものとして考える必要があります。 Definition - Domains vs. Zones の説明と短い DNS Zones の動画を見て、この違いを理解してください。

簡単に説明すると、ドメインを組織と考えた場合、ゾーンはその組織内の部署として捉えることができます。 このチュートリアルでは、ドメインは example.com であり、ゾーンも同様に example.com と呼んでいます。 (小さな組織では、部署が 1 つしかない場合があります。) 各 DNS ゾーンには、ゾーン内の IP アドレスとドメイン名を認識する特別なサーバーが必要です。 これらのリンクは、リソースレコード(RR)と呼ばれており、 それぞれに種類が異なる場合があります(DNS Record types をご覧ください)。 最も広く使用されているのは、A レコードです。

「ネームサーバー」は、ドメインレジストラが提供する特別なサーバーです。 たとえば、私が契約しているレジストラからは、次の 2 つのネームサーバーが提供されています。

ns39.domaincontrol.com

ns40.domaincontrol.com

次のようなリソースレコード(サーバードメイン名 = IP アドレス)を作成する必要があります。

zpm.example.com = 104.199.6.32

これは、ゾーン example.com に A レコードを作成して行います。 このレコードを保存すると、世界中にあるほかの DNS サーバーによってこの更新内容が認識され、最終的に、 zpm-registry を zpm.example.com:52773/registry/ という名前で参照できるようになります。

ドメインと kubernetes

覚えているかと思いますが、zpm サービスの IP アドレスは、Kubernetes Service(Load Balancer タイプ)をデプロイ中に作成されました。 zpm-registry を試して削除した後にもう一度 zpm-registry をデプロイすることにした場合は、別の IP アドレスが割り当てられる可能性があります。 その場合は、もう一度 DNS レジストラの Web コンソールにアクセスして、zpm.example.com の IP アドレスを新たに設定してください。

これには、もう 1 つの方法があります。 Kubernetes のデプロイ中に、External DNS という、Kubernetes Services または Ingress から新しく作成された IP アドレスを取得して対応する DNS レコードを作成する、ヘルパーツールをデプロイできます。 このツールはすべてのレジストラをサポートしているわけではありませんが、DNS ゾーン、ネームサーバーの提供、およびリソースレコードの保存を行える、Google Cloud DNS をサポートしています。

Google Cloud DNS を使用するには、レジストラの Web コンソールで、DNS ゾーンの example.com の管理を Google Cloud DNS に移行する必要があります。 これを行うには、ドメインレジストラが提供したネームサーバーを Google Cloud DNS が提供するものに変更します。 Google コンソールに example.com ゾーンを作成し、Google が提供するネームサーバーをコピーして貼り付けてください。 詳細は以下を参照してください。

コードに外部 DNS を追加して Google Cloud DNS を作成する方法を見てみましょう。 ただし、スペースを節約するために、ここではコードの一部のみを記載します。 前述のとおり、完全なサンプルは、 GitHub GKE TLS リポジトリにあります。

外部 DNS の追加

このアプリケーションを GKE にデプロイするには、Helm を利用します。 これについては、「An Introduction to Helm, the Package Manager for Kubernetes」と公式ドキュメント が役立つでしょう。

パイプラインファイルの「kubernetes-deploy」ステージの最後のジョブとして、次の行を追加してください。 また、「env」セクションには、新しい変数もいくつか追加します。

$ cat <root_repo_dir>/.github/workflows/workflow.yaml

...

env:

...

DNS_ZONE: example.com

HELM_VERSION: 3.1.1

EXTERNAL_DNS_CHART_VERSION: 2.20.6

...

jobs:

...

kubernetes-deploy:

...

steps:

...

- name: Install External DNS run: |

wget -q https://get.helm.sh/helm-v${HELM_VERSION}-linux-amd64.tar.gz

tar -zxvf helm-v${HELM_VERSION}-linux-amd64.tar.gz cd linux-amd64

./helm version

./helm repo add bitnami https://charts.bitnami.com/bitnami

gcloud container clusters get-credentials ${GKE_CLUSTER} --zone ${GKE_ZONE} --project ${PROJECT_ID}

echo ${GOOGLE_CREDENTIALS} > ./credentials.json

kubectl create secret generic external-dns --from-file=./credentials.json --dry-run -o yaml | kubectl apply -f -

./helm upgrade external-dns bitnami/external-dns \

--install \

--atomic \

--version=${EXTERNAL_DNS_CHART_VERSION} \

--set provider=google \

--set google.project=${PROJECT_ID} \

--set google.serviceAccountSecret=external-dns \

--set registry=txt \

--set txtOwnerId=k8s \

--set policy=sync \

--set domainFilters={${DNS_ZONE}} \

--set rbac.create=true

--set が設定するパラメータについては、External DNS チャートのドキュメントを参照してください。 とりあえず上記の行を追加して、次に進みましょう。

クラウド DNS の作成

まず、<root_repo_dir>/terraform/ ディレクトリに新しいファイルを追加します。 あなたのドメインゾーンを使用してください。

$ cat <root_repo_dir>/terraform/clouddns.tf

resource "google_dns_managed_zone" "my-zone" {

name = "zpm-zone"

dns_name = "example.com."

description = "My DNS zone"

}

また、Terraform に代わって機能するユーザーには、少なくとも次のロールが与えられていることを確認してください(DNS 管理者および Kubernetes Engine 管理者ロールに注意してください)。

GitHub Actions パイプラインを実行している場合は、これらが作成されます。 External DNS とCloud DNS の準備ができたら(実質的に準備できた時点で)、zpm-service をロードバランサーサービスタイプとは異なる方法で公開する方法を検討できるようになります。

Kubernetes

zpm-service は、通常の Kubernetes サービスロードバランサーを使って公開されています。 ファイル <root_repo_dir>/k8s/service.yaml を参照してください。 Kubernetes Service についての詳細は、「Service を使用したアプリケーションの公開」をお読みください。 重要なのは、ロードバランサーサービスにはドメイン名を設定する機能がないため、Kubernetes Services リソースが作成した実際の Google ロードバランサーが TCP/UDP レベルの OSI を操作するということです。 このレベルは、HTTP と証明書について何も関知していないため、 Google ネットワークロードバランサーを HTTP ロードバランサーに置き換える必要があります。 このようなロードバランサーを作るには、Kubernetes Service の代わりに Kubernetes Ingress リソースを使用できます。

ここで、「Kubernetes NodePort vs LoadBalancer vs Ingress? When should I use what?」を読んでおくと良いでしょう。

では、先に進みましょう。 コードでの Ingress の使用とはどいうことでしょうか。 <root_repo_dir>/k8s/ ディレクトリに移動し、次の変更を行います。 Service のタイプは NodePort です。

$ cat <root_repo_dir>/k8s/service.yaml

apiVersion: v1

kind: Service

metadata:

name: zpm-registry

namespace: iris

spec:

selector:

app: zpm-registry

ports:

- protocol: TCP

port: 52773

targetPort: 52773

type: NodePort

次に、Ingress マニフェストを追加する必要があります。

$ cat <root_repo_dir>/k8s/ingress.yaml

apiVersion: extensions/v1beta1

kind: Ingress

metadata:

annotations:

kubernetes.io/ingress.class: gce

networking.gke.io/managed-certificates: zpm-registry-certificate

external-dns.alpha.kubernetes.io/hostname: zpm.example.com

name: zpm-registry

namespace: iris

spec:

rules:

- host: zpm.example.com

http:

paths:

- backend:

serviceName: zpm-registry

servicePort: 52773

path: /*

また、太字で示されている行をワークフローファイルに追加します。

$ cat <root_repo_dir>/.github/workflows/workflow.yaml

...

- name: Apply Kubernetes manifests

working-directory: ./k8s/

...

kubectl apply -f service.yaml

kubectl apply -f ingress.yaml

このマニフェストをデプロイすると、Google Cloud コントローラによって、外部 HTTP ロードバランサーが作成されます。これは、ホストである zpm.example.com へのトラフィックをリスンし、このトラフィックを、Kubernetes NodePort Service デプロイ中に開かれたポート経由で、すべての Kubernetes ノードに送信します。 このポートは任意ですが、完全に自動化されているため、気にする必要はありません。

アノテーションを使用すると、Ingress のより詳細な構成を定義することができます。

annotations:

kubernetes.io/ingress.class: gce

networking.gke.io/managed-certificates: zpm-registry-certificate

external-dns.alpha.kubernetes.io/hostname: zpm.example.com

最初の行は、"gce" Ingress コントローラを使用することを示します。 このエンティティは、Ingress リソースに従って HTTP ロードバランサーを作成します。

2 行目は、証明書に関連する行です。 この設定については、後で説明します。

3 行目は、指定されたホスト名(zpm.example.com)を HTTP ロードバランサーの IP アドレスにバインドする外部 DNS を設定します。

このマニフェストを実装した場合、(約 10 分後に)Ingress が作成されてはいても、ほかのすべてが機能しているわけではないことがわかります。

"Backend services"とは何でしょうか。このうちの 1 つはうまく機能していないようです。

"k8s-be-31407-..." や "k8s-be-31445-..."などの名前がありますか? これらは、1 つの Kubernetes ノードで開かれているポートです。 ポートの番号はそれぞれ異なります。

31407 は、ヘルスチェック用に開かれているポートで、ノードが連続してアライブであるように、HTTP ロードバランサーが送信するポートです。

Kubernetes に接続して、ノードポート 31407 をプロキシすると、ヘルスチェックの結果を確認できます。

$ gcloud container clusters get-credentials <CLUSTER_NAME> --zone <LOCATION> --project <PROJECT_ID>

$ kubectl proxy &

$ curl localhost:8001/healthz

ok

$ fg

^Ctrl+C

もう 1 つの 31445 ポートは、zpm-registry サービス用に開かれている NodePort です。

$ kubectl -n iris get svc

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

zpm-registry NodePort 10.23.255.89 <NONE> 52773:31445/TCP 24m

また、デフォルトのヘルスチェックでは、HTTPロードバランサーはこのサービスが停止しているというレポートを送信します。 本当にそうなのでしょうか?

それらのヘルスチェックの詳細を確認する必要があります。 Backend service 名をクリックし、 下に少しスクロールして、ヘルスチェック名を確認してください。

詳細を確認するには、ヘルスチェック名をクリックします。

ヘルスチェックの "/" パスを "/csp/sys/UtilHome.csp" のように、IRIS が理解できるパスに置き換える必要があります。

$ curl -I localhost:52773/csp/sys/UtilHome.csp

Handling connection for 52773

HTTP/1.1 200 OK

では、ヘルスチェックに新しいパスを設定するには、どうすればよいのでしょうか。 デフォルトの "/" パスが存在する場合は、その代わりに、Readiness/Liveness probesを使用してください。

Kubernetes StatefulSet マニフェストにプローブを追加してみましょう。

$ cat <root_repo_dir>/k8s/statefulset.tpl

...

containers:

- image: DOCKER_REPO_NAME:DOCKER_IMAGE_TAG

...

ports:

- containerPort: 52773

name: web

readinessProbe:

httpGet:

path: /csp/sys/UtilHome.csp

port: 52773

initialDelaySeconds: 10

periodSeconds: 10

livenessProbe:

httpGet:

path: /csp/sys/UtilHome.csp

port: 52773

periodSeconds: 10

volumeMounts:

- mountPath: /opt/zpm/REGISTRY-DATA

name: zpm-registry-volume

- mountPath: /mount-helper

name: mount-helper

ここまでで、いくつかの変更を加えて、メインイベントである証明書への扉を開くことができました。 では、ラストスパートに取り掛かるとしましょう。

証明書の取得

Kubernetes の SSL/TLS 証明書を取得するさまざまな方法を説明した次の動画をぜひご覧ください。

Create a Kubernetes TLS Ingress from scratch in Minikube

Automatically Provision TLS Certificates in K8s with cert-manager

Use cert-manager with Let's Encrypt® Certificates Tutorial: Automatic Browser-Trusted HTTPS

Super easy new way to add HTTPS to Kubernetes apps with ManagedCertificates on GKE

要約すると、証明書を取得するにはいくつかの方法があり、openssl 自己証明書、Let’s Encrypt の certbot(手動)、Let's Encrypt に接続した cert-manager(自動)、そしてネイティブの Google アプローチである Managed Certificate を使用できます。ここでは、単純にするために、最後の Managed Certificate を使用します。

では追加しましょう。

$ cat <root_repo_dir>/k8s/managed-certificate.yaml

apiVersion: networking.gke.io/v1beta1

kind: ManagedCertificate

metadata:

name: zpm-registry-certificate

namespace: iris

spec:

domains:

- zpm.example.com

太字で示された行をデプロイパイプラインに追加します。

$ cat <root_repo_dir>/.github/workflows/workflow.yaml

...

- name: Apply Kubernetes manifests

working-directory: ./k8s/

run: |

gcloud container clusters get-credentials ${GKE_CLUSTER} --zone ${GKE_ZONE} --project ${PROJECT_ID}

kubectl apply -f namespace.yaml

kubectl apply -f managed-certificate.yaml

kubectl apply -f service.yaml

...

Ingress での有効化は、Ingress アノテーションとして先に行いましたが、覚えていますか?

$ cat <root_repo_dir>/k8s/ingress.yaml

...

annotations:

kubernetes.io/ingress.class: gce

networking.gke.io/managed-certificates: zpm-registry-certificate

...

これで、すべての変更をリポジトリにプッシュする準備が整いました。

$ git add .github/ terraform/ k8s/$ git commit -m "Add TLS to GKE deploy"$ git push

15 分ほどすると(クラスタプロビジョニングを実行する必要があります)、「緑信号」の Ingress を確認できるでしょう。

次に、Google が提供した少なくとも 2 つのネームサーバーをドメイン名レジストラコンソールで設定する必要があります(Google Domains 以外のレジストラを使用している場合)。

このプロセスはレジストラによって異なるため、ここでは説明しません。通常、レジストラのドキュメントで詳しく説明されています。

Google は、External DNS が自動的に作成した新しいリソースレコードをすでに認識しています。

$ dig +short @ns-cloud-b1.googledomains.com. zpm.example.com34.102.202.2

このレコードが世界中に伝搬されるまでにはしばらく時間がかかりますが、 とはいえ、最終的には次のようになります。

$ dig +short zpm.example.com34.102.202.2

証明書のステータスを確認することをお勧めします。

$ gcloud container clusters get-credentials <CLUSTER_NAME> --zone <LOCATION> --project <PROJECT_ID>

$ kubectl -n iris get managedcertificate zpm-registry-certificate -ojson | jq '.status'

{

"certificateName": "mcrt-158f20bb-cdd3-451d-8cb1-4a172244c14f",

"certificateStatus": "Provisioning",

"domainStatus": [

{

"domain": "zpm.myardyas.online",

"status": "Provisioning"

}

]

}

さまざまなステータスの意味については、「Google マネージド SSL 証明書の使用」のページをご覧ください。 証明書を初めてプロビジョニングする場合は、1 時間ほどかかることがあります。

domainStatus "FailedNotVisible" が発生することがありますが、 この場合は、Google ネームサーバーを DNS レジストラコンソールで実際に追加していることを確認してください。

certificateStatus と domainStatus の両方が利用可能になるまで待つことをお勧めします。「Google マネージド SSL 証明書の使用」で説明されているとおり、しばらく時間がかかることがありますが、 最終的には、次のようにして zpm-registry を呼び出せるようになるでしょう。

curl -XGET -u _system:SYS https://zpm.example.com/registry/packages/-/all

まとめ

Google は、Kubernetes リソースに基づいて、必要なすべての Google リソースを作成することに長けています。

また、Google マネージド証明書は、証明書の取得を大幅に単純化できる優れた機能です。

Google リソース(GKE、CloudDNS)の維持には費用が掛かります。そのため、いつものように不要になったら忘れずに削除するようにしてください。

記事

Shintaro Kaminaka · 2021年4月19日

開発者の皆さん、こんにちは。

このシリーズでは、IRIS for Healthの使い方ではなく、関連技術として、FHIRプロファイル作成ツールであるSUSHIの握り方使い方を紹介していきたいと思います。

このツールをうまく使うことで、FHIRプロジェクトのプロファイル情報(仕様や制限、拡張などの情報)をうまく整理し、公開することができます。

その前にSUSHIとは何でしょうか?簡単にですが、順番に説明していきたいと思います。

## FHIR って?

**FHIR**とは _Fast Healthcare Interoperability Resources_ の略であり、Web通信の一般的技術であるRESTを使用して、可読性が高く取り扱いがし易いJSON/XML形式の�データの集合(=リソース)をやり取りする短期間で実装可能な**医療情報交換標準規格**、という定義になっています。

簡単に言えば、医療のデータの表現方法として皆で共通したフォーマットを使うことによって、システム間や施設間などでの情報の伝達や交換をやりやすいようにしよう!ということですね。

FHIRには様々な[リソース](http://hl7.org/fhir/resourcelist.html)が定義されています。例えば患者さんの情報には[Patientリソース](http://hl7.org/fhir/patient.html)という定義があり、これを使って表現されます。

FHIR公式サイトには多くの[サンプル](http://hl7.org/fhir/patient-examples.html)が掲載されていますので、一部抜粋してみます。

例えばこのようなJSON形式で表現されます。患者番号(Identifier)、氏名(name)、性別(gender)などが表現されています。

```

{

"resourceType": "Patient",

"id": "pat1",

"text": {

"status": "generated",

"div": "\n \n Patient Donald DUCK @ Acme Healthcare, Inc. MR = 654321\n \n "

},

"identifier": [

{

"use": "usual",

"type": {

"coding": [

{

"system": "http://terminology.hl7.org/CodeSystem/v2-0203",

"code": "MR"

}

]

},

"system": "urn:oid:0.1.2.3.4.5.6.7",

"value": "654321"

}

],

"active": true,

"name": [

{

"use": "official",

"family": "Donald",

"given": [

"Duck"

]

}

],

"gender": "male",

"以下略"

}

```

## FHIRプロファイルって?

FHIRではJSONやXMLという表現形式だけではなく、何の情報をどのようなJSONキー名称で記載するか、どのようなコードを使用するか、どのような構造で表現するかいった決まりが存在します。それを[FHIRプロファイル](http://hl7.org/fhir/profiling.html)と呼んでいます。

プロファイルは用語として色々な意味で使われています。

広義では・・・

FHIRリソースおよびFHIRサーバに関する制約の定義の集合。それを表すアーティファクト(成果物)。

狭義では・・・

あるリソースに対して、特定の制約を適用したコンフォーマンス・リソース(適合性リソース) 。

この場合、プロファイルはリソース単位に存在する(例)Pateintプロファイル、Observationプロファイル…

詳細については、こちらの[FHIRプロファイルに関するJapan Virtual Summit 2021動画](https://youtu.be/B-B6ge_0nHg)をご覧ください。(約20分)

FHIRの公式Webサイトでは各リソースについて既定の仕様が開示されています。ですが、各リソースの使い方の自由度がとても高く、そのままでは実際に相互運用性のあるデータ交換をすることはこ困難です。ですので、事前の「申し合わせ」にもとづいて、リソースの記述に「規則」を改めて設ける必要があります。この「申し合わせ」「規則」に相当するのは、実装ガイドライン(Implementation Guide)とプロファイル(Profile)に相当します。

実装ガイドラインは主に文章で記述されたもので、WordやExcel、HTML等でも記述されています。一方、ProfileはFHIRのStructureDefinitionリソースを使って計算可能なJSON形式で記述をしています。このFHIRのプロファイル自体もFHIRのリソースで表現できる、というのがFHIRの特徴の一つでもあります。例えばIRIS for Healthのような製品でその定義を取り込んで、機能拡張ができるように、JSON形式で仕様まで表現できるようになっているのです。

実装ガイドラインは様々なツールで作れますが、米国HL7協会はProfileから実装ガイドラインを自動的に生成するIG Publisherを公開しています。このツールを使えば、米国HL7協会が出しているフォーマットで実装ガイドラインのHTMLファイル等を生成することができます。この記事後半ではその方法についても紹介しています。

例えばこれは、US Coreと呼ばれる米国で標準的に使用されることが推奨されたPatientリソースの記法上の規約を表現した、「StructureDefinition」というリソースです。

([引用元](https://www.hl7.org/fhir/us/core/StructureDefinition-us-core-patient.json.html))

```

{

"resourceType" : "StructureDefinition",

"id" : "us-core-patient",

"text" : {

"status" : "extensions",

"div" : "省略"

},

"url" : "http://hl7.org/fhir/us/core/StructureDefinition/us-core-patient",

"version" : "3.1.1",

"name" : "USCorePatientProfile",

"title" : "US Core Patient Profile",

"status" : "active",

"experimental" : false,

"date" : "2020-06-27",

"publisher" : "HL7 US Realm Steering Committee",

"contact" : [

{

"telecom" : [

{

"system" : "url",

"value" : "http://www.healthit.gov"

}

]

}

],

"以下略"

```

FHIRプロファイルを表現されるリソースとしては他にも[ImplementationGuide](http://hl7.org/fhir/implementationguide.html)やFHIRサーバの一連の機能をまとめた[CapabilityStatement](http://hl7.org/fhir/capabilitystatement.html)などがあります。

## FHIR Shorthand とは?

というわけで、ではFHIRプロファイルを作成するには↑のJSON構造を作っていけばいいんだな!?ということになる訳ですが、これを手作業でやるのはどう考えて難しいし煩雑ですよね。間違えそうです。

これを補助するためのアプリケーションやツールが公開されており、商用製品やオープンソースなどいくつかの選択肢があります。

こちらの[ページ](https://confluence.hl7.org/pages/viewpage.action?pageId=35718864#ProfileTooling-Editing&AuthoringProfiles)をご覧ください。

例えばオランダのFirely社のForgeなどは有名ですが、最近では**FHIR Shorthand** ([リンク](https://build.fhir.org/ig/HL7/fhir-shorthand/index.html))という**FHIRアーティファクトを定義するためのドメイン固有の言語**も広く使われるようになってきています。

FHIR Shorthandは言語の一種であり、例えば以下のような定義ファイル=FSH(フィッシュ)ファイルを作成しながら、FHIRプロファイルを作成することができます。

以下にサンプルのFSHファイルを例示します。[引用元](https://build.fhir.org/ig/HL7/fhir-shorthand/overview.html#fsh-line-by-line-walkthrough) 例えば、このプロファイルの名前(Profile: CancerDiseaseStatus)、ベースとなる元のFHIRリソース(Parent: Observation)、カーディナリティを変更するエレメントの指定(bodySite 0..0)などの内容を含んでいます。

```

Alias: LNC = http://loinc.org

Alias: SCT = http://snomed.info/sct

Profile: CancerDiseaseStatus

Parent: Observation

Id: mcode-cancer-disease-status

Title: "Cancer Disease Status"

Description: "A clinician's qualitative judgment on the current trend of the cancer, e.g., whether it is stable, worsening (progressing), or improving (responding)."

* ^status = #draft

* extension contains EvidenceType named evidenceType 0..*

* extension[evidenceType].valueCodeableConcept from CancerDiseaseStatusEvidenceTypeVS (required)

* status and code and subject and effective[x] and valueCodeableConcept MS

* bodySite 0..0

* specimen 0..0

* device 0..0

* referenceRange 0..0

* hasMember 0..0

* component 0..0

* interpretation 0..1

* subject 1..1

* basedOn only Reference(ServiceRequest or MedicationRequest)

(省略)

```

## SUSHIって?

FHIR/FHIRプロファイル/FHIR Shorthandと順に説明してきましたが、ついにSUSHIの説明です。

SUSHI (an acronym for “SUSHI Unshortens SHorthand Inputs”) (4) is a reference implementation of a FSH compiler that translates FSH into FHIR artifacts such as profiles, extensions, and value sets. SUSHI is installed on your own computer and runs locally from the command line. ([引用元](https://build.fhir.org/ig/HL7/fhir-shorthand/overview.html#sushi))

> (訳)SUSHI("SUSHI Unshortens SHorthand Inputs "の略)は、FSHファイルをプロファイル、エクステンション、バリューセットなどのFHIRアーティファクトに変換するFSHコンパイラのリファレンス実装である。SUSHIは自分のコンピュータにインストールされ、コマンドラインからローカルに実行される。

つまり、**先ほどのFHIR Shorthandを記述したFSH(フィッシュ)ファイルを、SUSHIで処理すると、StructureDefinitionなどのファイルが生成される**、ということです。

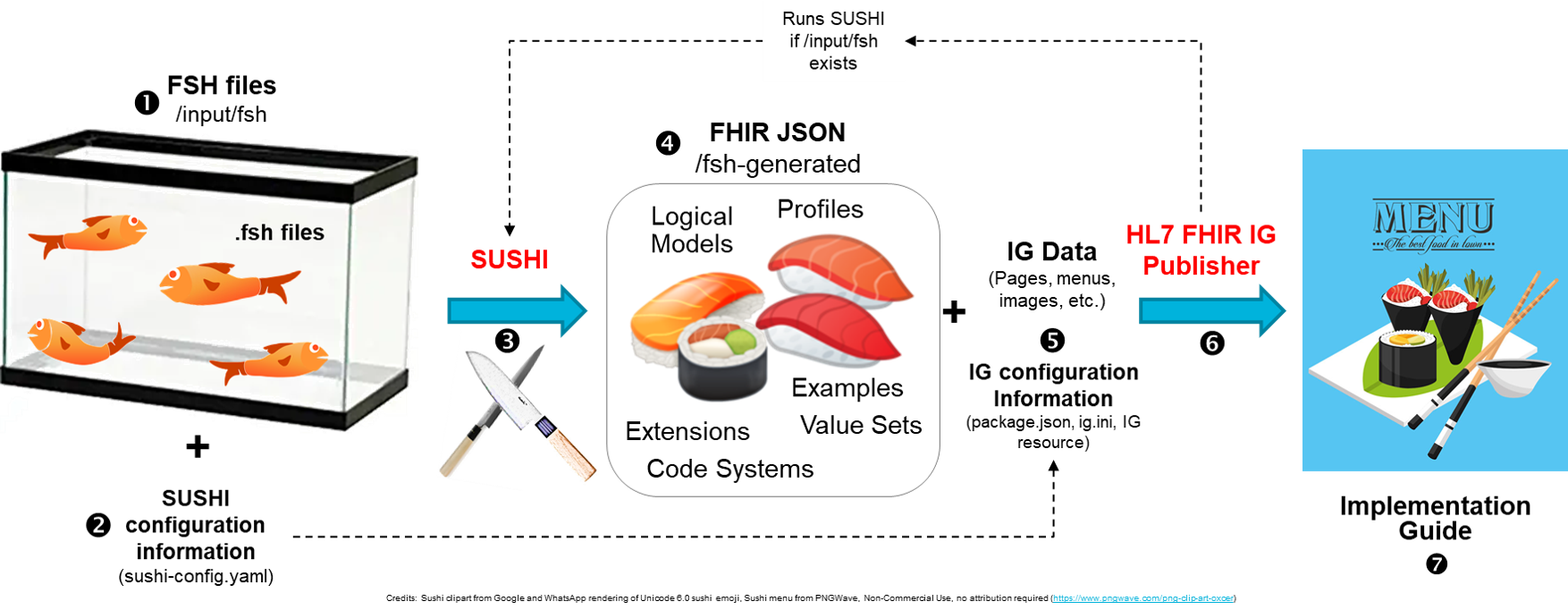

この仕組みを説明したわかりやいようで、ちょっとわかりにくい一枚の絵があります

(この絵では、魚を処理(=コンパイル)して、寿司ができるようなイメージで書かれてるんですが、実際はコンパイルをしているのが「SUSHIコンパイラ」で、できあがるのは「プロファイルなどのFHIRアーティファクト」なのでちょっと違うと思うんですよね・・・。お寿司の説明にProfilesやExtensions等の記載はありますけども。)

駆け足でSUSHIとは何か、までご紹介してきましたがご理解いただけたでしょうか?

## FSH Schoolに行こう

肝心なSUSHIのインストール方法や基本的な使い方ですが、それらについてはここで説明するよりも、非常に丁寧に紹介されたオフィシャルサイトがありますので、そちらをご紹介したいと思います。

その名も[FSH School](https://fshschool.org/)です。

SUSHIを使って生成されるのは、StrudctureDefinitionなどのリソース(JSONファイル)ですが、同じくこのサイトで紹介されている、"IG Publisherツール"を使うことによって、それらを取りまとめたHTMLのソースまで生成することができます。

まずはこの[SUSHI Tutorial](https://fshschool.org/docs/tutorials/basic/)に内容に沿って、基本的な機能の確認をされることをお勧めします。

うまくいかないときは、ダウンロードできるフォルダに含まれる完成版FSH Tank(!)であるFishExampleCompleteディレクトリを参照されると良いと思います。

私はWindows環境で試しました。Node.jsもインストールされていなかったので、[こちらのサイト](https://blog.katsubemakito.net/nodejs/install-windows10)の情報を参考にさせていただきました。

また、チュートリアルに以下の記載がある通り、IG Publisherを使ったHTMLファイルの出力には Jekyll というツールが必要になります。

>Warning

Before proceeding to the next command: If you have never run the IG Publisher, you may need to install Jekyll first. See Installing the IG Publisher for details.

こちらの[サイト](http://jekyll-windows.juthilo.com/1-ruby-and-devkit/)からJekyllのキット等は入手できます。

## SUSHI実行例

私の環境で、チュートリアルの完成版を使ったsushiコマンド実行結果を掲載します。

コマンド等の詳細はこちらのサイト([Running SUSHI](https://fshschool.org/docs/sushi/running/))をご覧ください。

```

>sushi .

info Running SUSHI v1.2.0 (implements FHIR Shorthand specification v1.1.0)

info Arguments:

info C:\Users\kaminaka\Documents\Work\FHIR\SUSHI\fsh-tutorial-master\FishExampleComplete

info No output path specified. Output to .

info Using configuration file: C:\Users\kaminaka\Documents\Work\FHIR\SUSHI\fsh-tutorial-master\FishExampleComplete\sushi-config.yaml

info Importing FSH text...

info Preprocessed 2 documents with 3 aliases.

info Imported 4 definitions and 1 instances.

info Checking local cache for hl7.fhir.r4.core#4.0.1...

info Found hl7.fhir.r4.core#4.0.1 in local cache.

info Loaded package hl7.fhir.r4.core#4.0.1

(node:26584) Warning: Accessing non-existent property 'INVALID_ALT_NUMBER' of module exports inside circular dependency

(Use `node --trace-warnings ...` to show where the warning was created)

(node:26584) Warning: Accessing non-existent property 'INVALID_ALT_NUMBER' of module exports inside circular dependency

info Converting FSH to FHIR resources...

info Converted 3 FHIR StructureDefinitions.

info Converted 1 FHIR ValueSets.

info Converted 1 FHIR instances.

info Exporting FHIR resources as JSON...

info Exported 5 FHIR resources as JSON.

info Assembling Implementation Guide sources...

info Generated ImplementationGuide-fish.json

info Assembled Implementation Guide sources; ready for IG Publisher.

╔════════════════════════ SUSHI RESULTS ══════════════════════════╗

║ ╭──────────┬────────────┬───────────┬─────────────┬───────────╮ ║

║ │ Profiles │ Extensions │ ValueSets │ CodeSystems │ Instances │ ║

║ ├──────────┼────────────┼───────────┼─────────────┼───────────┤ ║

║ │ 2 │ 1 │ 1 │ 0 │ 1 │ ║

║ ╰──────────┴────────────┴───────────┴─────────────┴───────────╯ ║

║ ║

╠═════════════════════════════════════════════════════════════════╣

║ It doesn't get any betta than this! 0 Errors 0 Warnings ║

╚═════════════════════════════════════════════════════════════════╝

```

実行するとFSHファイルのコンパイルが実行され、最後にいくつのProfilesやExtensionが生成されたか、表示されます。問題なければ、"info"だけが表示されますが、FSHファイルの定義に誤りがあると、WarningやErrorも表示されます。エラーメッセージは比較的親切で何が問題が把握しやすいと思います。(個人的には最後の表に掲載される、なぞの「魚一言?」みたいな一文が楽しみです。)

実行後には、プロジェクトフォルダ内のfsh-generatedフォルダにStructureDefinitionのJSONファイルが生成されているのが確認できます。

続いて、「_updatePublisher」コマンドで、IG Publisherツールを入手し、「_genonce」コマンドでIG Publisherを起動し、HTMLファイル群も生成してみます。この実行ログは長いので割愛します。

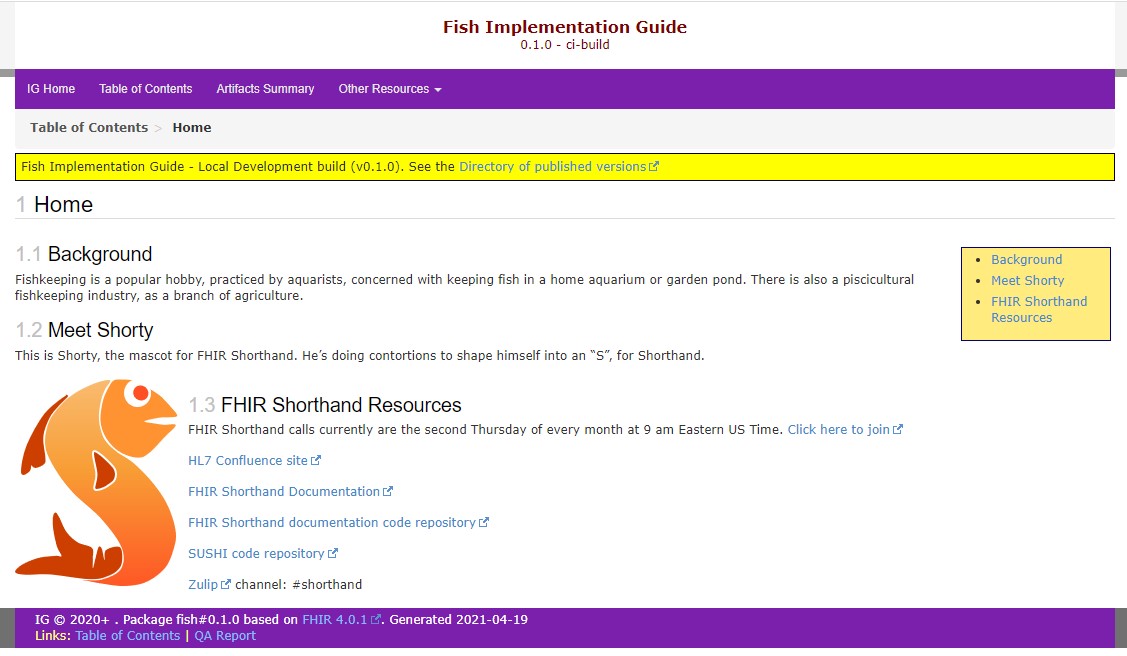

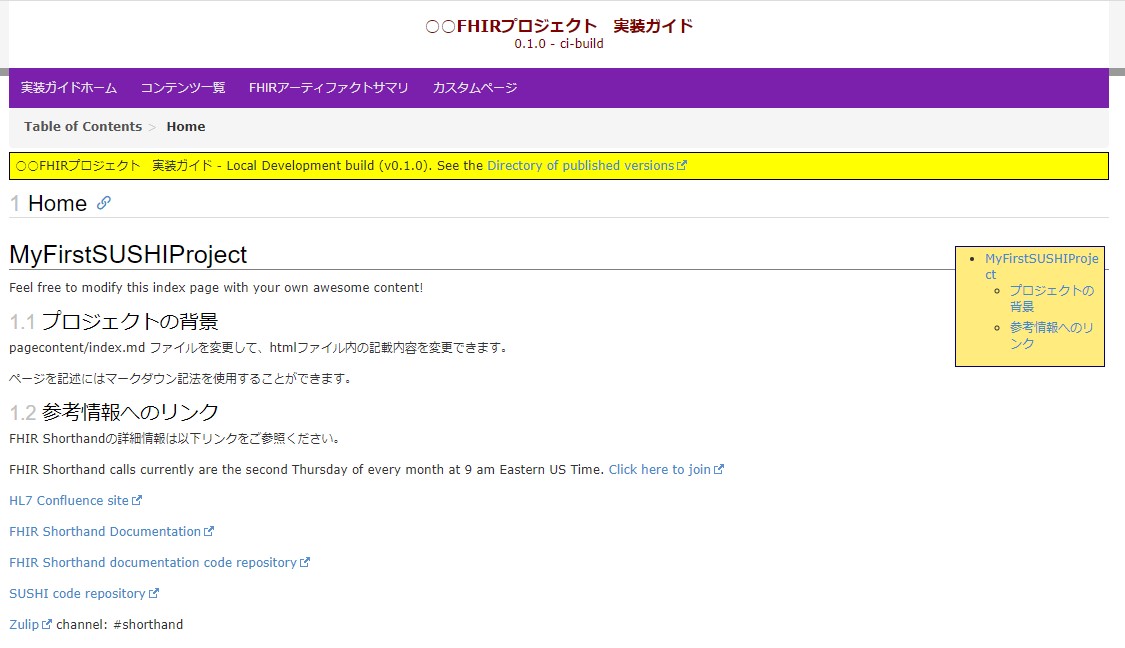

実行後、同じプロジェクトフォルダ内の output フォルダを確認すると多くのファイルが生成されているのがわかります。index.htmlファイルを開くと以下のようなページが生成されていることが確認できます。

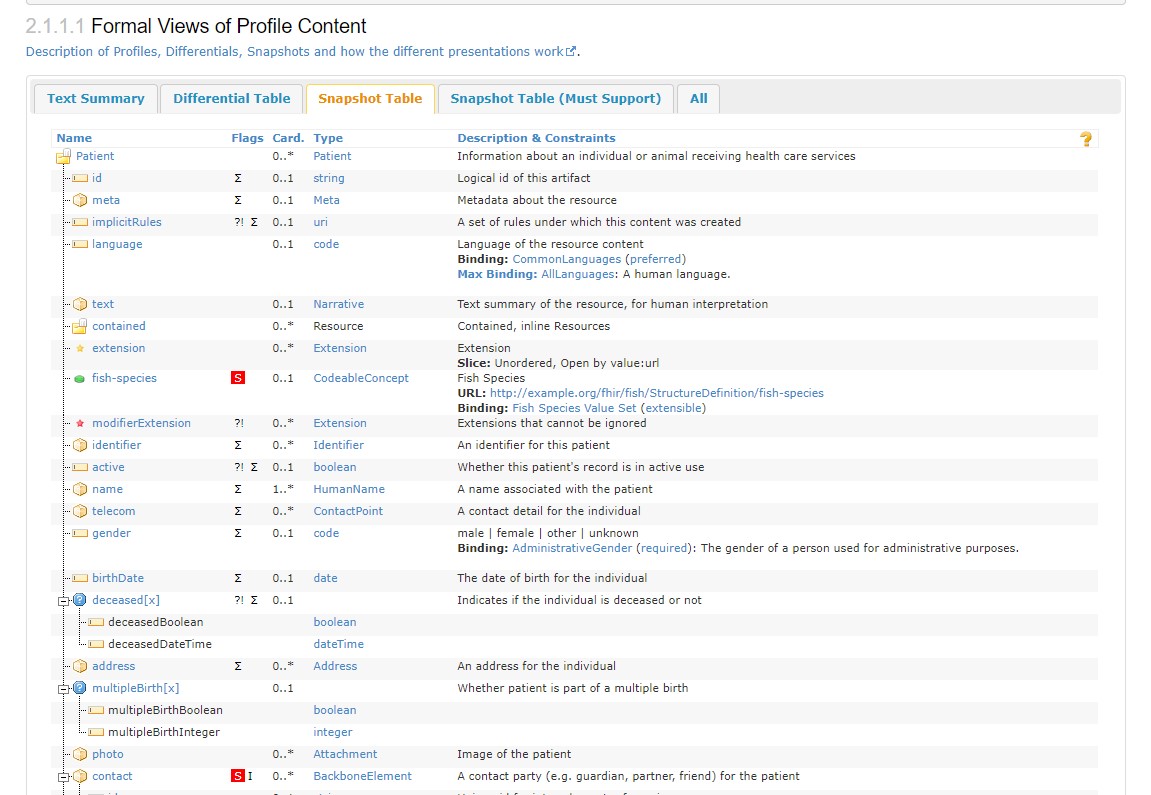

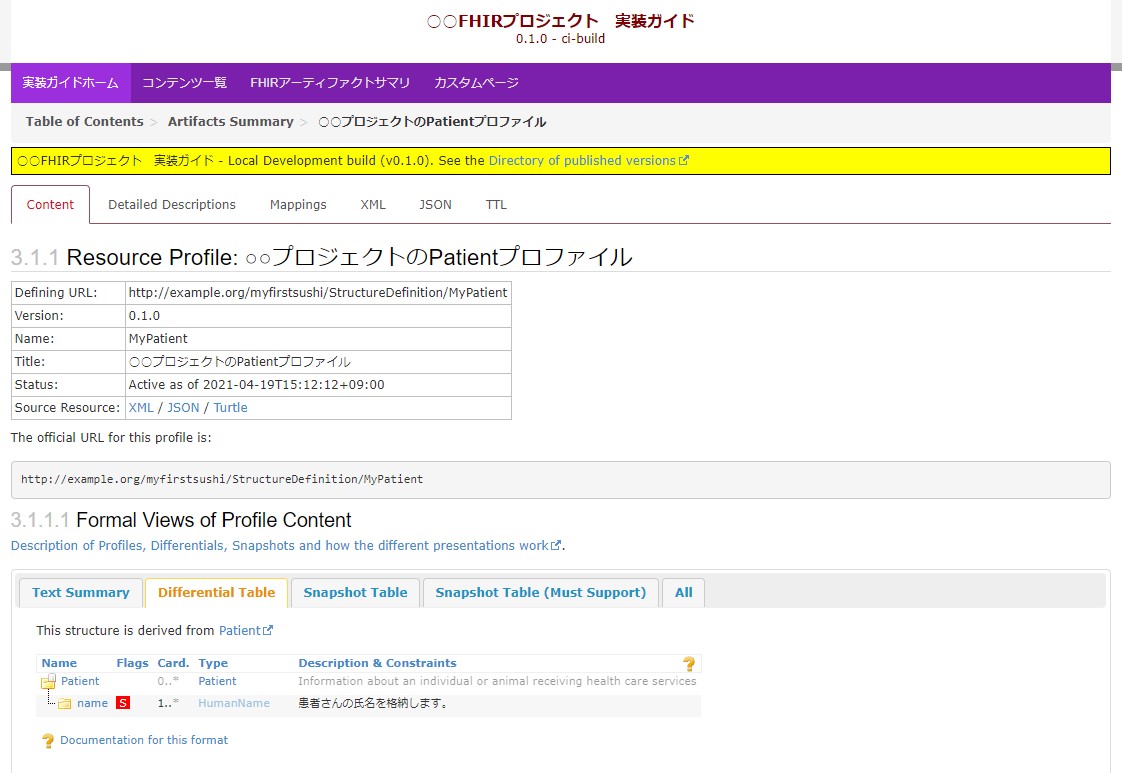

このようなFHIR公式サイトでも見慣れた、リソースの説明ページなども自動生成されます。

## Implementation Guide(実装ガイド)を書いてみよう

私もこのツール群を触り始めて日が浅いですが、簡単なスタートアップとして、実装ガイドを記述していく方法をご紹介したいと思います。

詳細な使い方についてはFSH Schoolサイト内の情報をご覧ください。[こちら](https://fshschool.org/downloads/)で紹介されているのFHIR DevDaysのスライド等も大変参考になると思います。

まず sushi --init コマンドでプロジェクト構造のひな型を作りましょう。

```

C:\Users\kaminaka\Documents\Work\FHIR\SUSHI\TestProject>sushi --init

╭───────────────────────────────────────────────────────────╮

│ This interactive tool will use your answers to create a │

│ working SUSHI project configured with your project's │

│ basic information. │

╰───────────────────────────────────────────────────────────╯

Name (Default: ExampleIG): MyFirstSUSHIProject

Id (Default: fhir.example): myfirstsushi

Canonical (Default: http://example.org): http://example.org/myfirstsushi

Status (Default: draft):

Version (Default: 0.1.0):

Initialize SUSHI project in C:\Users\kaminaka\Documents\Work\FHIR\SUSHI\TestProject\MyFirstSUSHIProject? [y/n]: y

Downloading publisher scripts from https://github.com/HL7/ig-publisher-scripts

(node:13972) Warning: Accessing non-existent property 'INVALID_ALT_NUMBER' of module exports inside circular dependency

(Use `node --trace-warnings ...` to show where the warning was created)

(node:13972) Warning: Accessing non-existent property 'INVALID_ALT_NUMBER' of module exports inside circular dependency

╭───────────────────────────────────────────────────────────╮

│ Project initialized at: ./MyFirstSUSHIProject │

├───────────────────────────────────────────────────────────┤

│ Now try this: │

│ │

│ > cd MyFirstSUSHIProject │

│ > sushi . │

│ │

│ For guidance on project structure and configuration see │

│ the SUSHI documentation: https://fshschool.org/docs/sushi │

╰───────────────────────────────────────────────────────────╯

```

実行すると必要最低限の設定ファイルやFSHファイルが作成されます。

次に少し修正をしてみましょう。

その前にエディタの紹介です。fshファイルを修正するための[Extension](https://marketplace.visualstudio.com/items?itemName=kmahalingam.vscode-language-fsh)が公開されているので、Visual Studio Codeの使用がおすすめです。

せっかくなので、日本語の情報を入力してどのように反映されるか見ていきたいと思います。

まず、sushi-config.yaml を修正します。実装ガイドのタイトルを追加し、メニュー画面も日本語表記に変更した上で、コンテンツ一覧ページ(tuc.html)とカスタムページ(mycustompage.html)を追加しています。

sushi-config.yaml

```

# ╭──────────────────────────────────────ImplementationGuide───────────────────────────────────────╮

# │ The properties below are used to create the ImplementationGuide resource. For a list of │

# │ supported properties, see: https://fshschool.org/sushi/configuration/ │

# ╰────────────────────────────────────────────────────────────────────────────────────────────────╯

id: myfirstsushi

canonical: http://example.org/myfirstsushi

name: MyFirstSUSHIProject

# titleを追加して、ページ上部に表示されるようにします。

title: ○○FHIRプロジェクト 実装ガイド

status: draft

publisher: InterSystems Japan/S.Kaminaka

description: SUSHIを使ったFHIRプロジェクト実装ガイドのサンプルです。

version: 0.1.0

fhirVersion: 4.0.1

copyrightYear: 2021+

releaseLabel: ci-build

# ╭────────────────────────────────────────────menu.xml────────────────────────────────────────────╮

# │ To use a provided input/includes/menu.xml file, delete the "menu" property below. │

# ╰────────────────────────────────────────────────────────────────────────────────────────────────╯

# メニューを日本語表示されるように変更します。

menu:

実装ガイドホーム: index.html

コンテンツ一覧: toc.html

FHIRアーティファクトサマリ: artifacts.html

カスタムページ: mycustompage.html

```

インデックスページや、カスタムページはマークダウンで記述できます。

index.md

```

# MyFirstSUSHIProject

Feel free to modify this index page with your own awesome content!

### プロジェクトの背景

pagecontent/index.md ファイルを変更して、htmlファイル内の記載内容を変更できます。

ページを記述にはマークダウン記法を使用することができます。

### 参考情報へのリンク

(略)

```

mycustompage.md

```

## これはカスタムページです。

マークダウンファイルを用意しておくとhtmlファイルが生成されます。

プロジェクトに応じたページを生成し、実装ガイドに含めることができます。

```

最後に最も重要なFSHファイルを修正します。このひな形には、Patientプロファイル用のFSHファイルが含まれているので、それを少しだけ修正しました。

patient.fsh

```

// This is a simple example of a FSH file.

// This file can be renamed, and additional FSH files can be added.

// SUSHI will look for definitions in any file using the .fsh ending.

Profile: MyPatient

Parent: Patient

Title: "○○プロジェクトのPatientプロファイル"

* name 1..* MS

// ^shortを変更して、一覧表示画面の説明部分を変更できます。

* name ^short = "患者さんの氏名を格納します。"

* name ^definition = "患者さんの氏名を格納するエレメント。NeXEHRS JP COREに準拠した漢字・カナ記法を使用します。"

```

それでは、以下のコマンドを実行して、生成された実装ガイドページを確認してみましょう。

> sushi.

> _updatePublisher

> _genonce

以下のような情報を含むページが簡単に生成できます。

あわせてStructureDefinitionやImplementationGuideなどのJSONファイルももちろん生成されています。

## まとめ

いかがでしたでしょうか?

単にFHIRプロファイルのJSONファイルを生成するだけでなく、HTMLファイルを生成する機能も付随しているので、このツールをうまく使えばFHIRの仕様を分かりやすく伝えることが可能なコンテンツが簡単に作成できるのではないかと考えています。

このツール自体はInterSystemsとは直接関係ない製品ではありますが、FHIRプロジェクトの情報交換に役立つツールということで、この開発者コミュニティでご紹介させていただきました。

この記事を見て試していただいた方、あるいはすでに使いこなしている方、使い方のコツや便利な機能やシンタックスなどをご紹介いただけると嬉しく思います。

次回のこのシリーズでは、SUSHIで生成したSearch Parameterの定義ファイルをIRIS for Healthで読み込んで、検索パラメータを拡張する内容に取り組んでみたいと考えています。

(2021/4/20 特にプロファイルの説明について、説明が曖昧な箇所をご指摘いただきましたので修正しました。ご指摘ありがとうございました。)

記事

Mihoko Iijima · 2022年3月29日

これは、InterSystems FAQサイトの記事です。

データベースの空き容量は、システムモニタを使用して監視することができます。

システムモニタは、システム開始時に自動開始され、予め設定された閾値に対してアラートが通知されます。

システムの閾値については以下ドキュメントをご参照ください。システム・モニタのステータスおよびリソース・メトリック【IRIS】システム・モニタのステータスおよびリソース・メトリック

データベースの空き容量については、システムデフォルトでは 50 MBを下回る場合にアラートが通知され、メッセージログ(コンソールログ)にアラート(深刻度 2)として記録され、alerts.log ファイルにも出力されます。

データベースの空き容量を任意サイズで監視したい場合、システムモニタに含まれる「アプリケーションモニタ」を利用して設定します。注意:アプリケーションモニタでは、アラート対象となる情報があってもメッセージログ(コンソールログ)に出力しないため、メール通知/メソッド実行 を使用して通知するように設定します。

例えば、空き容量が 100MB を下回った時にアラートを通知したい場合は、アプリケーションモニタが提供する %Monitor.System.Sample.Freespace(空き容量メトリック)を利用します。

その他のアプリケーションモニタの閾値(メトリック)については、以下ドキュメントをご参照ください。アプリケーション・モニタのメトリック【IRIS】アプリケーション・モニタのメトリック

システム提供のアプリケーションモニタは、デフォルトでは全て無効化されています。使用を開始するためには、対象のモニタを有効化し、システムモニタを再起動します。

アプリケーションモニタの有効/無効やシステムモニタの停止/開始は、システムルーチン ^%SYSMONMGR を利用します。

以下の例では、データベースの空き容量が 100MB を下回る場合にメール通知を行う設定手順について説明します。

手順は以下の通りです。

1) ^%SYSMONMGR を起動し、アプリケーションモニタから %Monitor.System.Freespace を有効化する

2) アラート対象とする閾値を変更する(例では、通知は最初の1回のみとしています)

3) Email通知設定を行う

4) システムモニタを再起動する

1) ^%SYSMONMGR を起動し、アプリケーションモニタから %Monitor.System.Freespace を有効化する

ドキュメントは以下ご参照ください。Manage Monitor Classes【IRIS】Manage Monitor Classes

%SYS>do ^%SYSMONMGR

1) Start/Stop System Monitor

2) Set System Monitor Options

3) Configure System Monitor Classes

4) View System Monitor State

5) Manage Application Monitor

6) Manage Health Monitor

7) View System Data

8) Exit

Option? 5 → 5 を入力してEnter押下

1) Set Sample Interval

2) Manage Monitor Classes

3) Change Default Notification Method

4) Manage Email Options

5) Manage Alerts

6) Exit

Option? 2 → 2 を入力してEnter押下

1) Activate/Deactivate Monitor Class

2) List Monitor Classes

3) Register Monitor System Classes

4) Remove/Purge Monitor Class

5) Set Class Sample Interval

6) Debug Monitor Classes

7) Exit

Option? 1 → 1 を入力してEnter押下

Class? ? → ? を入力してEnter押下

Num MetricsClassName Activated

1) %Monitor.System.HistoryMemory N

2) %Monitor.System.HistoryPerf N

3) %Monitor.System.HistorySys N

4) %Monitor.System.HistoryUser N

5) %Monitor.System.AuditCount N

6) %Monitor.System.AuditEvents N

7) %Monitor.System.Clients N

8) %Monitor.System.Diskspace N

9) %Monitor.System.Freespace N

10) %Monitor.System.Globals N

11) %Monitor.System.Journals N

12) %Monitor.System.License N

13) %Monitor.System.LockTable N

14) %Monitor.System.Processes N

15) %Monitor.System.Routines N

16) %Monitor.System.Servers N

17) %Monitor.System.SystemMetrics N

18) %Monitor.System.CSPGateway N

Class? 9 %Monitor.System.Freespace →上のリストの 9 を指定してEnter押下

Activate class? Yes => yes → yes を入力してEnter押下

1) Activate/Deactivate Monitor Class

2) List Monitor Classes

3) Register Monitor System Classes

4) Remove/Purge Monitor Class

5) Set Class Sample Interval

6) Debug Monitor Classes

7) Exit Option? →Enter押下(前のメニューに戻ります)

1) Set Sample Interval

2) Manage Monitor Classes

3) Change Default Notification Method

4) Manage Email Options

5) Manage Alerts

6) Exit

Option?

2) アラート対象とする閾値を変更する(例では、通知は最初の1回のみとしています)

※以下実行例は、1) の続きで記述しています。^%SYSMONMGRの実行から始めている場合は、5) Manage Application Monitor 選択後の画面から開始してください。

ドキュメントは以下ご参照ください。Manage Alerts【IRIS】Manage Alerts

1) Set Sample Interval

2) Manage Monitor Classes

3) Change Default Notification Method

4) Manage Email Options

5) Manage Alerts

6) Exit

Option? 5 → 5 を入力してEnter押下

1) Create Alert

2) Edit Alert

3) List Alerts

4) Delete Alert

5) Enable/Disable Alert

6) Clear NotifyOnce Alert

7) Exit

Option? 1 → 1 を入力してEnter押下

Alert name? test database free space alert → 任意のアラート名を入力してEnter押下

Application? %SYS (Enter '-' to reset) => → Enter押下

Action (0=default,1=email,2=method)? 0 => 1 → 1 を入力してEnter押下

Raise this alert during sampling? Yes => yes → yes を入力してEnter押下

Class? ? → ? を入力してEnter押下

Num MetricsClassName Activated

1) %Monitor.System.HistoryMemory N

2) %Monitor.System.HistoryPerf N

3) %Monitor.System.HistorySys N

4) %Monitor.System.HistoryUser N

5) %Monitor.System.AuditCount N

6) %Monitor.System.AuditEvents N

7) %Monitor.System.Clients N

8) %Monitor.System.Diskspace N

9) %Monitor.System.Freespace Y

10) %Monitor.System.Globals N

11) %Monitor.System.Journals N

12) %Monitor.System.License N

13) %Monitor.System.LockTable N

14) %Monitor.System.Processes N

15) %Monitor.System.Routines N

16) %Monitor.System.Servers N

17) %Monitor.System.SystemMetrics N

18) %Monitor.System.CSPGateway N

Class? 9 %Monitor.System.Freespace → 上のリストの 9 を指定してEnter押下

Property? ? → ? を入力してEnter押下

Num Name Activated

1) CurSize Y

2) DBName Y

3) Directory Y

4) DiskFreeSpace Y

5) FreeSpace Y

6) MaxSize Y

Property? 5 FreeSpace → 上のリストの 5 を指定してEnter押下

Property? Properties list: FreeSpace

Evaluation expression (e.g., "%1=99")? %1<100 ←MB単位に指定します。例では「100MB未満の場合アラート」を指定してEnter押下

Expression expands to: If FreeSpace<100. OK? Yes => Yes → Yes を入力してEnter押下

Notify once only? No => yes → yes を入力してEnter押下

1) Create Alert

2) Edit Alert

3) List Alerts

4) Delete Alert

5) Enable/Disable Alert

6) Clear NotifyOnce Alert

7) Exit

Option? →Enter押下(前のメニューに戻ります)

1) Set Sample Interval

2) Manage Monitor Classes

3) Change Default Notification Method

4) Manage Email Options

5) Manage Alerts

6) Exit

Option? →Enter押下(前のメニューに戻ります)

3) Email通知設定を行う

以下の例では、gmail を利用する例をご紹介しています。gmail は SSL構成を事前に作成する必要があります。管理ポータルの以下メニューから事前に作成してください。

管理ポータル > システム管理 > セキュリティ管理 > SSL/TLS構成

※以下実行例は、2)の続きで記述しています。^%SYSMONMGR の実行から始めている場合は、5) Manage Application Monitor 選択後の画面から開始してください。

ドキュメントは以下ご参照ください。Manage Email Options【IRIS】Manage Email Options

1) Start/Stop System Monitor

2) Set System Monitor Options

3) Configure System Monitor Classes

4) View System Monitor State

5) Manage Application Monitor

6) Manage Health Monitor

7) View System Data

8) Exit

Option? 5 → 5 を入力してEnter押下

1) Set Sample Interval

2) Manage Monitor Classes

3) Change Default Notification Method

4) Manage Email Options

5) Manage Alerts

6) Exit

Option? 4 → 4 を入力してEnter押下

1) Enable/Disable Email

2) Set Sender

3) Set Server

4) Manage Recipients

5) Set Authorization

6) Test Email

7) Exit

Option? 3 → 3 を入力してEnter押下

Mail server? smtp.gmail.com → メールサーバを入力してEnter押下

Mail server port? 587 → メールサーバのポート番号を入力してEnter押下

Mail server SSLConfiguration? gmail → 管理ポータルで設定したSSL構成名を入力してEnter押下

Mail server UseSTARTTLS? 0 => 1 → 1を入力してEnter押下

1) Enable/Disable Email

2) Set Sender

3) Set Server

4) Manage Recipients

5) Set Authorization

6) Test Email

7) Exit

Option? 2 → 2 を入力してEnter押下

Sender? sendertest@gmail.com → 差出人のメールアドレスを入力してEnter押下

1) Enable/Disable Email

2) Set Sender

3) Set Server

4) Manage Recipients

5) Set Authorization

6) Test Email

7) Exit

Option? 5 → 5 を入力してEnter押下

User name? xxxabctestaccount@gmail.com → 認証用アカウント名を入力してEnter押下

Password? → パスワードを入力してEnter押下

1) Enable/Disable Email

2) Set Sender

3) Set Server

4) Manage Recipients

5) Set Authorization

6) Test Email

7) Exit

Option? 4 → 4 を入力してEnter押下

1) List Recipients

2) Add Recipient

3) Remove Recipient

4) Exit

Option? 2 → 2 を入力してEnter押下

Email Address? abc@testcorp.com → 送信先メールアドレスを入力してEnter押下

1) List Recipients

2) Add Recipient

3) Remove Recipient

4) Exit

Option? →Enter押下(前のメニューに戻ります)

1) Enable/Disable Email

2) Set Sender

3) Set Server

4) Manage Recipients

5) Set Authorization

6) Test Email

7) Exit

Option? 1 → 1 を入力してEnter押下

Email is currently OFF

Change Email setting? No => yes → yes を入力してEnter押下

1) Enable/Disable Email

2) Set Sender

3) Set Server

4) Manage Recipients

5) Set Authorization

6) Test Email

7) Exit

Option? 6 → 6 を入力してEnter押下

Sending email on Mail Server smtp.gmail.com

From: sendertest@gmail.com

To: abc@testcorp.com

1) Enable/Disable Email

2) Set Sender

3) Set Server

4) Manage Recipients

5) Set Authorization

6) Test Email

7) Exit

Option? →Enter押下(前のメニューに戻ります)

1) Set Sample Interval

2) Manage Monitor Classes

3) Change Default Notification Method

4) Manage Email Options

5) Manage Alerts

6) Exit

Option? →Enter押下(前のメニューに戻ります)

1) Start/Stop System Monitor

2) Set System Monitor Options

3) Configure System Monitor Classes

4) View System Monitor State

5) Manage Application Monitor

6) Manage Health Monitor

7) View System Data

8) Exit

Option? →Enter押下(前のメニューに戻ります)

4) システムモニタを再起動する

設定を反映させるため、システムモニタを一度停止し、開始します。

ドキュメントは以下ご参照ください。Start/Stop System Monitor【IRIS】Start/Stop System Monitor

%SYS>do ^%SYSMONMGR

1) Start/Stop System Monitor

2) Set System Monitor Options

3) Configure System Monitor Classes

4) View System Monitor State

5) Manage Application Monitor

6) Manage Health Monitor

7) View System Data

8) Exit

Option? 1 → 1 を入力してEnter押下

1) Start System Monitor

2) Stop System Monitor

3) Exit

Option? 2 → 2 を入力してEnter押下

Stopping System Monitor... System Monitor stopped

1) Start System Monitor

2) Stop System Monitor

3) Exit

Option? 1 → 1 を入力してEnter押下

Starting System Monitor... System Monitor started

1) Start System Monitor

2) Stop System Monitor

3) Exit

Option? →Enter押下(前のメニューに戻ります)

1) Start/Stop System Monitor

2) Set System Monitor Options

3) Configure System Monitor Classes

4) View System Monitor State

5) Manage Application Monitor

6) Manage Health Monitor

7) View System Data

8) Exit

Option? →Enter押下(ネームスペースのプロンプトに戻ります)

%SYS>

記事

Toshihiko Minamoto · 2023年2月8日

InterSystems IRIS 2020.1 には、重要なアプリケーションの構築を支援する新機能と機能改善が多数盛り込まれています。 2019.1 から 2020.1 までに行われた多数の大幅なパフォーマンス改善のほかに、最近の SQL の歴史において最も大きな変更点の 1 つであるユニバーサルクエリキャッシュ(UQC)が導入されています。 この記事では、SQL ベースのアプリケーションに対するそのインパクトについて、技術的な観点で詳しく説明しています。

### UQC とは?

スクラブルで頭字語として使用されればゲームチェンジャーとなる可能性もあるでしょうが、ユニバーサルクエリキャッシュは、あらゆる種類の SQL ステートメントを単一のキャッシュで管理することで、ボード全体の SQL 操作を単純化することを目的としています。 これまでは、[動的 SQL](https://docs.intersystems.com/irislatest/csp/docbookj/Doc.View.cls?KEY=GSQL_dynsql)(%SQL.Statementインフラストラクチャを使用)や JDBC 、 ODBC にて発行されるステートメントは、Prepare 時に [キャッシュドクエリ](https://docs.intersystems.com/irislatest/csp/docbookj/Doc.View.cls?KEY=GSQLOPT_cachedqueries)として最適化されたコードにコンパイルされていました。 一方、[埋め込み SQL](https://docs.intersystems.com/irislatest/csp/docbookj/Doc.View.cls?KEY=GSQL_esql) を使用する場合(&SQL() 構文を使用)、クエリを実行するコードはインラインで生成され、アプリケーションの一部となっていました。 このため、埋め込み SQL は、IRIS がサポートする他のすべての形態の SQL クエリとは非常に異なって処理されていました。

キャッシュドクエリクラスは、ステートメントを発行したコードから独立しており、新しいインデックスの追加やアップグレードの後に、更新されたテーブルの統計に基づいてより効率的なアクセスパスを得るなどのために、必要に応じてパージしたり生成し直したりすることが可能です([アップグレード時に凍結されたクエリプラン](https://docs.intersystems.com/irislatest/csp/docbookj/Doc.View.cls?KEY=GSQLOPT_frozenplans#GSQLOPT_frozenplans_upgrade)の注意事項もご覧ください)。 一方、埋め込み SQL は静的であり、新しいテーブル統計とインデックスを自動的に利用することができませんでした。

2020.1 では、ユニバーサルクエリキャッシュの導入により、埋め込み SQL にもキャッシュ済みクエリクラスを生成できるようになり、このコードをアプリケーションロジックを保持するクラスに混在させることがなくなりました。 最も重要なメリットは、埋め込み SQL では、より新しいテーブル統計または新しいインデックスを利用するために、ソースクラスを再コンパイルする必要がなくなったことです。 UQC で参照されているテーブルが更新されると、新しいキャッシュ済みクエリクラスが自動的に生成されるため、生成可能な最も効率の良いコードが確実に実行されます。 埋め込み SQL をクラスに生成すると、他のすべてのクエリが既に使用しているより高速なカーソル変数ストレージを利用できます。 つまり、膨大な作業を行うクエリが以前よりも速く実行されるということです。 また、UQC によって、クラスのコンパイル順の管理において管理者を悩ませることの多かったクラス間の SQL 依存関係がすべて取り除かれます。

これによって作業が大きく変わります。多大な労力をつぎ込んで、「想像力に溢れる」セットアップに対応するために大規模なテストを行ってはいるものの(デプロイ済みのコード、アプリケーションコード内でのネームスペースの切り替えなど)、その想像を超えるセットアップがまだまだ存在するかもしれません。 そのため、埋め込み SQL を大量に(そして創造性豊かに)使用しているアプリケーションを 2020.1 にアップグレードする際には、特に注意してください。また、通常と異なることに気づいた場合は、[WRC](http://wrc.intersystems.com/) までご連絡ください。

### 埋め込み SQL と動的 SQL は 1 つに統一されたのですか?

動的 SQL と埋め込み SQL の使用方法については、現在でもセマンティックがある程度異なっています。 埋め込み SQL は名前付きカーソルを操作しますが、これは動的 SQL のクエリに対する実際のオブジェクトハンドルを操作するよりも少し扱いにくいものです。 ただし、これは個人の好みに大きく左右される問題であるため、明らかに、楽しむためだけに、あるフレーバーから別のフレーバーにアプリケーションを書き直す理由はありません。

パフォーマンスについては、埋め込み SQL には動的 SQL よりも高速だという評判がありましたが、ここ数年におけるコード生成とオブジェクト処理の改善により、その差はほとんどなくなっています。 とは言え、埋め込み SQL のカーソルの値は変数に直接取得することが可能であるため、動的 SQL の相当するオブジェクトプロパティを通じて値にアクセスするよりも、わずかに高速ではあります。 したがって、確かにより高速ではありますが、その差はほんのわずかであるため、多くの場合、(主観的に!)開発の利便性を上回ることはありません。

### 但し書き

UQC の導入により、2020.1 の埋め込み SQL に、同じルーチンまたはクラスのコンテキストにとどまるのではなく、キャッシュ済みクエリオブジェクト内の別のクラスメソッドをバックグラウンドで呼び出してクエリを実行するという、以前にはなかった非常に小さくも固定されたオーバーヘッドが存在するようになりました。 キャッシュ済みのクエリコードの生成とコンパイルにおける作業は、以前は、&SQL() コンストラクトを含むクラスまたはルーチンのコンパイルの一環でしたが、現在は、動的 SQL と同様に、またより現実的なテーブル統計を利用して、クエリが初めて呼び出されるときに行われるようになっています。 開発者は、新しい /compileembedded=1 コンパイルフラグを使って埋め込み SQL を強制的にコンパイルできます。

これとは別に、生成されたキャッシュ済みのクエリコードで高速な i%var アクセスを使用してカーソルの状態情報を保持するのには様々なメリットがあり、ほとんどの重要なクエリで固定オーバーヘッドが相殺され、実際に埋め込み SQL が以前のバージョンよりも高速になります。 パフォーマンスが低下する可能性があるのは、2019.4 に比べれば、ほんの少数のステートメント(非常に単純な INSERT など)です。 独自に行った実験では、そのような単純なクエリでは約 6%、複雑なクエリでは 3% のパフォーマンスの_増加_が見られました。

一方で、2019.4 より前のバージョンからアップグレードするユーザーは、パフォーマンスの_改善_以外は、何も感じられない可能性があります。 2019.1 から 2019.4 までは、SQL とカーネルレイヤーにおいて、UQC で導入される小さな固定オーバーヘッドをはるかに上回る他のパフォーマンス改善が多数行われているためです。 これらの多数の変更点の概要については、[こちらの GS セッション録画](https://community.intersystems.com/post/new-video-sql-performance-need-speed)をご覧ください。

### まとめ

簡単に言えば、ユニバーサルクエリキャッシュによって、最新の統計と利用可能なインデックスを考慮するようにクエリプランが素早く確実に更新されるため、DBA の業務がより楽になります。 特に、SQL アプリケーションを別のお客様環境にデプロイする場合には、一番ピッタリな SQLを開発者が自由に選択できる重要な機能強化と言えます。

この記事は、@Mark.Hansonと@ Tom.Woodfin からいただいた貴重な貢献に基づいています

記事

Toshihiko Minamoto · 2024年3月25日

バージョン 2023.3(InterSystems IRIS for Health)の新機能は、FHIR プロファイル基準の検証を実行する機能です。

(*)

この記事では、この機能の基本的な概要を説明します。

FHIR が重要な場合は、この新機能を絶対にお試しになることをお勧めします。このままお読みください。

背景情報

FHIR 規格は、$validate という演算を定義します。 この演算は、リソースを検証する API を提供することを意図しています。

FHIR Validation に関する概要を理解するには、こちらの FHIR ドキュメントをご覧ください。

また、Global Summit 2023 での私の「Performing Advanced FHIR Validation」セッションもご覧ください。最初の方で、様々な種類の検証に関する情報を提供しています。

この検証の一部は、特定のプロファイルに対する検証です。 プロファイリングについてはこちらをご覧ください。

簡単な例として、Patient Resource の基本的な FHIR 定義では、識別子の基数を '0..*' として定義します。つまり、Patient には識別子が何もなく(ゼロ)、それでも有効であるということです。 しかし、US Core Patient Profile は、'1..*' の帰趨を定義しています。つまり、Patient に識別子がない場合、有効ではないということになります。

別の例では、上記の US Core Patient の例に従うと、race や birthsex などの拡張が使用されることがあります。

FHIR Profiling についての詳細は、Global Summit 2022 で @Patrick.Jamieson3621 が講演した 「Using FHIR Shorthand」セッションをご覧ください。Pat が FSH(FHIR の略)の使用について説明していますが、Profiling の一般的なトピックの説明から始まっています。

以前のバージョンでは、FHIR Server はこの種(プロファイルベース)の検証をサポートしていませんでしたが、最新バージョン(2023.3)からはサポートされています。

使用方法

ドキュメントには、プロファイルベースの検証に $validate を呼び出す方法についてのセクションが含まれています。

$validate 演算を呼び出す基本的な方法には 2 つあります。

クエリ URL でのプロファイリング

1 つ目は、Request Body の Resource と URL パラメーターとしてのプロファイルを含めた POST 送信です。

たとえば、Postman では:

または curl を使用(プロファイル URL パラメーターの値のスラッシュのエンコーディングに注意してください。Postman によって処理されます):

curl --location 'http://fhirserver/endpoint/Patient/$validate?profile=http%3A%2F%2Fhl7.org%2Ffhir%2Fus%2Fcore%2FStructureDefinition%2Fus-core-patient' --header 'Content-Type: application/fhir+json' --header 'Accept: application/fhir+json' --header 'Authorization: Basic U3VwZXJVc2VyOnN5cw==' --data "@data.json"

上記で参照される data.json には、例としてこの有効な US Core Patient が含まれています。

{

"resourceType" : "Patient",

"id" : "example",

"meta" : {

"profile" : ["http://hl7.org/fhir/us/core/StructureDefinition/us-core-patient|7.0.0-ballot"]

},

"text" : {

"status" : "generated",

"div" : "<div xmlns=\"http://www.w3.org/1999/xhtml\"><p style=\"border: 1px #661aff solid; background-color: #e6e6ff; padding: 10px;\"></div>"

},

"extension" : [{

"extension" : [{

"url" : "ombCategory",

"valueCoding" : {

"system" : "urn:oid:2.16.840.1.113883.6.238",

"code" : "2106-3",

"display" : "White"

}

},

{

"url" : "ombCategory",

"valueCoding" : {

"system" : "urn:oid:2.16.840.1.113883.6.238",

"code" : "1002-5",

"display" : "American Indian or Alaska Native"

}

},

{

"url" : "ombCategory",

"valueCoding" : {

"system" : "urn:oid:2.16.840.1.113883.6.238",

"code" : "2028-9",

"display" : "Asian"

}

},

{

"url" : "detailed",

"valueCoding" : {

"system" : "urn:oid:2.16.840.1.113883.6.238",

"code" : "1586-7",

"display" : "Shoshone"

}

},

{

"url" : "detailed",

"valueCoding" : {

"system" : "urn:oid:2.16.840.1.113883.6.238",

"code" : "2036-2",

"display" : "Filipino"

}

},

{

"url" : "text",

"valueString" : "Mixed"

}],

"url" : "http://hl7.org/fhir/us/core/StructureDefinition/us-core-race"

},

{

"extension" : [{

"url" : "ombCategory",

"valueCoding" : {

"system" : "urn:oid:2.16.840.1.113883.6.238",

"code" : "2135-2",

"display" : "Hispanic or Latino"

}

},

{

"url" : "detailed",

"valueCoding" : {

"system" : "urn:oid:2.16.840.1.113883.6.238",

"code" : "2184-0",

"display" : "Dominican"

}

},

{

"url" : "detailed",

"valueCoding" : {

"system" : "urn:oid:2.16.840.1.113883.6.238",

"code" : "2148-5",

"display" : "Mexican"

}

},

{

"url" : "text",

"valueString" : "Hispanic or Latino"

}],

"url" : "http://hl7.org/fhir/us/core/StructureDefinition/us-core-ethnicity"

},

{

"url" : "http://hl7.org/fhir/us/core/StructureDefinition/us-core-birthsex",

"valueCode" : "F"

}

],

"identifier" : [{

"use" : "usual",

"type" : {

"coding" : [{

"system" : "http://terminology.hl7.org/CodeSystem/v2-0203",

"code" : "MR",

"display" : "Medical Record Number"

}],

"text" : "Medical Record Number"

},

"system" : "http://hospital.smarthealthit.org",

"value" : "1032702"

}],

"active" : true,

"name" : [{

"use" : "old",

"family" : "Shaw",

"given" : ["Amy",

"V."],

"period" : {

"start" : "2016-12-06",

"end" : "2020-07-22"

}

},

{

"family" : "Baxter",

"given" : ["Amy",

"V."],

"suffix" : ["PharmD"],

"period" : {

"start" : "2020-07-22"

}

}],

"telecom" : [{

"system" : "phone",

"value" : "555-555-5555",

"use" : "home"

},

{

"system" : "email",

"value" : "amy.shaw@example.com"

}],

"gender" : "female",

"birthDate" : "1987-02-20",

"address" : [{

"use" : "old",

"line" : ["49 MEADOW ST"],

"city" : "MOUNDS",

"state" : "OK",

"postalCode" : "74047",

"country" : "US",

"period" : {

"start" : "2016-12-06",

"end" : "2020-07-22"

}

},

{

"line" : ["183 MOUNTAIN VIEW ST"],

"city" : "MOUNDS",

"state" : "OK",

"postalCode" : "74048",

"country" : "US",

"period" : {

"start" : "2020-07-22"

}

}]

}

この演算のリソースは OperationOutcome Resource です。

Resource が有効(上記のとおり)である場合、この種のレスポンスが得られます。

{

"resourceType": "OperationOutcome",

"issue": [

{

"severity": "information",

"code": "informational",

"details": {

"text": "All OK"

}

}

]

}

ただし、例えば上記の Resource から識別子を省略すると、この OperationOutcome が得られます。

{

"resourceType": "OperationOutcome",

"issue": [

{

"severity": "error",

"code": "invariant",

"details": {

"text": "generated-us-core-patient-1: Constraint violation: identifier.count() >= 1 and identifier.all(system.exists() and value.exists())"

},

"diagnostics": "Caused by: [[expression: identifier.count() >= 1, result: false, location: Patient]]",

"expression": [

"Patient"

]

}

]

}

クエリ本文でのプロファイリング

データを $validate に送信するもう 1 つの方法は、Parameters 配列内のリソースをプロファイルやその他のオプションとともに指定して POST 送信することです。

Postman では、これは以下のようになります。

curl を使用した場合:

curl --location 'http://fhirserver/endpoint/Patient/$validate' --header 'Content-Type: application/fhir+json' --header 'Accept: application/fhir+json' --header 'Authorization: Basic U3VwZXJVc2VyOnN5cw==' --data "@data.json"

URL にはプロファイルは含まれませんが、ボディのペイロード(または上記の例の data.json)は以下のようになります。

{

"resourceType": "Parameters",

"parameter": [

{

"name": "mode",

"valueString": "profile"

},

{

"name": "profile",

"valueUri": "http://hl7.org/fhir/us/core/StructureDefinition/us-core-patient"

},

{

"name": "resource",

"resource": {

"resourceType": "Patient"

}

}

]

}

実際の Patient Resource は前の例と同じであるため除外しました。

ただし、ここで異なるのは、mode パラメーター要素と profile パラメーター要素であり、リソースは「resource」という独自のパラメーター要素内に含まれています。

ID が URL のどこに含まれるかなど(たとえば、更新または削除を検証するため)、mode のその他のオプションについては、上記で参照したドキュメントをご覧ください。

便宜上、上記のサンプルリクエストなどの Postman コレクションを含む単純な Open Exchange パッケージを作成しました。

コードを使用

標準 REST API 経由で $validate 演算を呼び出す代わりに、ユースケースが適切であれば、内部的にクラスメソッドを呼び出すこともできます。

既存の HS.FHIRServer.Util.ResourceValidator:ValidateResource() メソッド(こちらのドキュメントでも説明)と同様に、ValidateAgainstProfile() という新しいメソッドも追加されており、それを利用できます。

範囲

現在(v2023.3)では、この種の検証(プロファイル基準の検証)は $validate 演算の一部としてのみ行われ、Resource の作成や更新時には行われないことに注意しておくことが重要です。 そこでは、より「基本的な」検証が行われます。 必要であれば、より「高度な」プロファイル基準の検証を使って、POST または PUT される前に Resouce を実行することができます。

別のオプションも、今後のバージョンで提供される可能性があります。

セットアップに関する注意事項

一般に、FHIR Server がほとんどの Profile Validator セットアップを処理します。

確認が必要なのは、サポートされている Java 11 JDK がインストールされていることです(現在、Oracle のものか OpenJDK のもの)。

詳細は、Profile Validation Server の構成に関するドキュメントをご覧ください。

基本的に、Validator JAR を実行するために、外部言語(Java)サーバーが実行中であることが確認されています(JAR ファイルはインストールフォルダの dev/fhir/java にあります。ちなみに、logs フォルダを覗くと、以下のような警告が表示されます:

CodeSystem-account-status.json : Expected: JsonArray but found: OBJECT for element: identifier

気にする必要はありません。 Validator はデフォルトで多数のプロファイルを読み込むものであり、その一部にはフォーマットエラーがあります)。

つまり、外部言語サーバーのリストを見ると、以下のようなものを確認できます。

Validator がプロファイルに対して検証する必要がある場合、初めてプロファイルをロードする必要があることに注意してください。そのため、パフォーマンスを向上させるために、HS.FHIRServer.Installer:InitalizeProfileValidator() メソッドを呼び出すことができます。

do ##class(HS.FHIRServer.Installer).InitializeProfileValidator()

これについても上記で参照したドキュメントには、Validator の構成に関して説明されています。

実際、この呼び出しをインスタンスの %ZSTART 起動ルーチンに含めることもできます。

また、これについても関連するクラスリファレンスで説明されています。

このメソッドは、検証操作中にプロファイルを読み込むことによるパフォーマンスへの影響がないように、インスタンスまたは外部言語サーバーの再起動後に呼び出すことが推奨されています。

今後の予定

今後のバージョンでは、Validator 内と Validator 周りにより多くの機能を提供する予定です。

ただし、例えば現時点でも、外部用語サーバーを使った検証(LOINC コードなど)を実行する場合、別のアプローチを使用することができます。1 つは、前述の Global Summit セッションで説明と実践が行われている方法で、同僚の @Dmitry.Zasypkin のサンプル(Open Exchange で提供)に基づくものです。

謝辞

この新機能を調べながらこの記事を準備するにあたって貴重な情報を提供してい頂いた @Kimberly.Santos にお礼申し上げます。

(*)Microsoft Bing の DALL-E 3 を使用して上記の画像を作成してくれた画像クリエーターに感謝しています。

記事

Toshihiko Minamoto · 2020年4月21日

Mirroring 101

Cachéミラーリングは、CachéおよびEnsembleベースのアプリケーションに適した信頼性が高く、安価で実装しやすい高可用性および災害復旧ソリューションです。 ミラーリングは幅広い計画停止シナリオや計画外停止シナリオで自動フェイルオーバーを提供するもので、通常はアプリケーションの回復時間を数秒に抑制します。 論理的にデータが複製されるため、単一障害点およびデータ破損の原因となるストレージが排除されます。 ほとんど、またはダウンタイムなしでアップグレードを実行できます。

ただし、Cachéミラーの展開にはかなり大がかりな計画が必要であり、さまざまな手順が要求されます。 また、他の重要なインフラストラクチャコンポーネントと同様に、運用中のミラーには継続的な監視とメンテナンスが必要とされます。

この記事はよくある質問のリスト、あるいはミラーリングの理解と評価、ミラーの計画、ミラーの設定、ミラーの管理という簡単な一連のガイドとして利用することができます。 それぞれの回答には、各トピックの詳細なディスカッションへのリンクと各タスクの段階的手順へのリンクが含まれています。

ミラーを導入する計画を始める準備ができたら、まずはCaché高可用性ガイドの「ミラーリング」の章のミラーリングのアーキテクチャと計画セクションから必ず読み始めるようにしてください。

よくある質問

ミラーリングの理解と評価

ミラーリングのメリットとは?

仮想化環境にミラーを導入できますか?

クラウドにミラーを導入できますか?

ミラーの基本的な設計はどうなっていますか?

データベースのコピーは、実際の本番データベースとどのように同期されますか?

自動フェールオーバーはどのようにトリガーされますか? フェールオーバーで対応できない状況はありますか?

ミラーは災害復旧(DR)機能を提供しますか?

ミラーの計画

ミラーのアーキテクチャはどのように計画すべきですか? メンバー構成や物理的配置はどのようになりますか?

ネットワークや遅延に関してどのようなことを考慮すべきですか? ミラーにはどのようなネットワーク構成が必要ですか?

フェイルオーバー時にアプリケーションの接続を新しいプライマリにリダイレクトするためのオプションにはどのようなものがありますか?

ミラー内のCachéインスタンスの互換性要件にはどのようなものがありますか?

既存のデータベースをミラーに移行するには?

仮想化環境にミラーを導入する場合に考慮すべきことはありますか?

ミラーの設定

どのような構成ガイドラインを考慮する必要がありますか?

ミラーを保護するには?

ミラー仮想IPアドレス(ミラーVIP)を構成するには?

アービターはどこにどのように配置すべきですか?

ISCAgentをインストールして起動するには?

ミラーを作成して構成するには?

ミラーデータベースを作成するには? 既存のデータベースをミラーに追加するには?

フェールオーバーした後、ECPにアプリケーションサーバーの接続をリダイレクトさせるには?

クラウドなどでミラーVIPが使用できない場合にアプリケーションの接続をリダイレクトさせるには?

Cachéシャドウをミラーに変換するには?

他にどのような構成情報を調べる必要がありますか?

ミラーの管理

ミラーの動作状態を監視するには?

ミラーを変更するには?変更できる 設定は?

ミラーにメンバーを追加できますか? メン バーを削除できますか? ミラーを完全に削除するには?

メンバーをミラーから一時的に削除する必要がある場合は?

ミラーはまとめてアップグレードする必要がありますか? そのためには、ミラーを本番環境から外す必要がありますか?

他にどのようなミラーまたはミラー関連の管理手順と情報を知っておくべきですか?

ミラーの停止手順

ミラーリングの理解と評価

ミラーリングのメリットとは?

CachéおよびEnsembleベースのアプリケーションでは、主にフェールオーバークラスター 、仮想化HA 、およびCachéミラーリングの3つの手法で高可用性を確保しています。 最初の2つの最大の欠点は、共有ストレージに依存していることです。そのため、ストレージの障害が発生すると甚大な被害が発生します。これは必要に応じてストレージレベルで冗長性を確保することにより改善できますが、ある種のデータ破損も引き続き発生する可能性があります。 さらに、ソフトウェアのアップグレードにはかなりのダウンタイムが必要であり、多くの障害ではアプリケーションの復旧に数分程度の時間を要する可能性があります。

ミラーリングでは2つの物理的に独立したシステムを使用して別々のストレージに論理データを複製することで、共有ストレージの問題を回避しています。また、アップグレードに必要とされるダウンタイムはゼロまたは最小限に抑えられているため、アプリケーションの復旧時間は通常数秒となります。 また、この手法では本番データセンターから適切な距離に災害復旧サイトを配置し、ミラーリングによる信頼性の高い堅牢な災害復旧機能を提供することができます。